イギリスの企業Stability AIが公開したテキストから画像生成するAI.「Stable Diffusion」をローカル環境で動かしてみました。

CG制作業を行っているmocoの要望により構築したもので、なるべく初心者にもわかりやすいように画像を多めに用意しました。

この記事では

fa-check-circle-o参考記事

fa-check-circle-o実際に環境構築した手順

をまとめています。

コンテンツ

参考記事

今回参考にさせて頂いたのはこちらの記事。

■Stable Diffusionをローカルマシンで実行する(VSCodeとDevcontainerを使用)

Anacondaを使用して環境構築の情報もあったものの、自分の環境では上手くいかず。

検証環境

- OS: Windows 10 Pro

- CPU: Intel(R) Core(TM) i7-10870H

- メモリ: 32GB

- GPU: NVIDIA GeForce RTX 3070 Laptop GPU (8GB)

環境構築の流れ

- Hugging Faceのトークンを発行

- CUDAのインストール

- Dockerのインストール

- Visual Studio Codeのインストール

- Visual Studio Codeに拡張機能をインストール

- Stable Diffusionで画像生成

1.Hugging Faceのトークンを発行

Gigazineの記事の手順でHugging Faceのトークンを発行します。

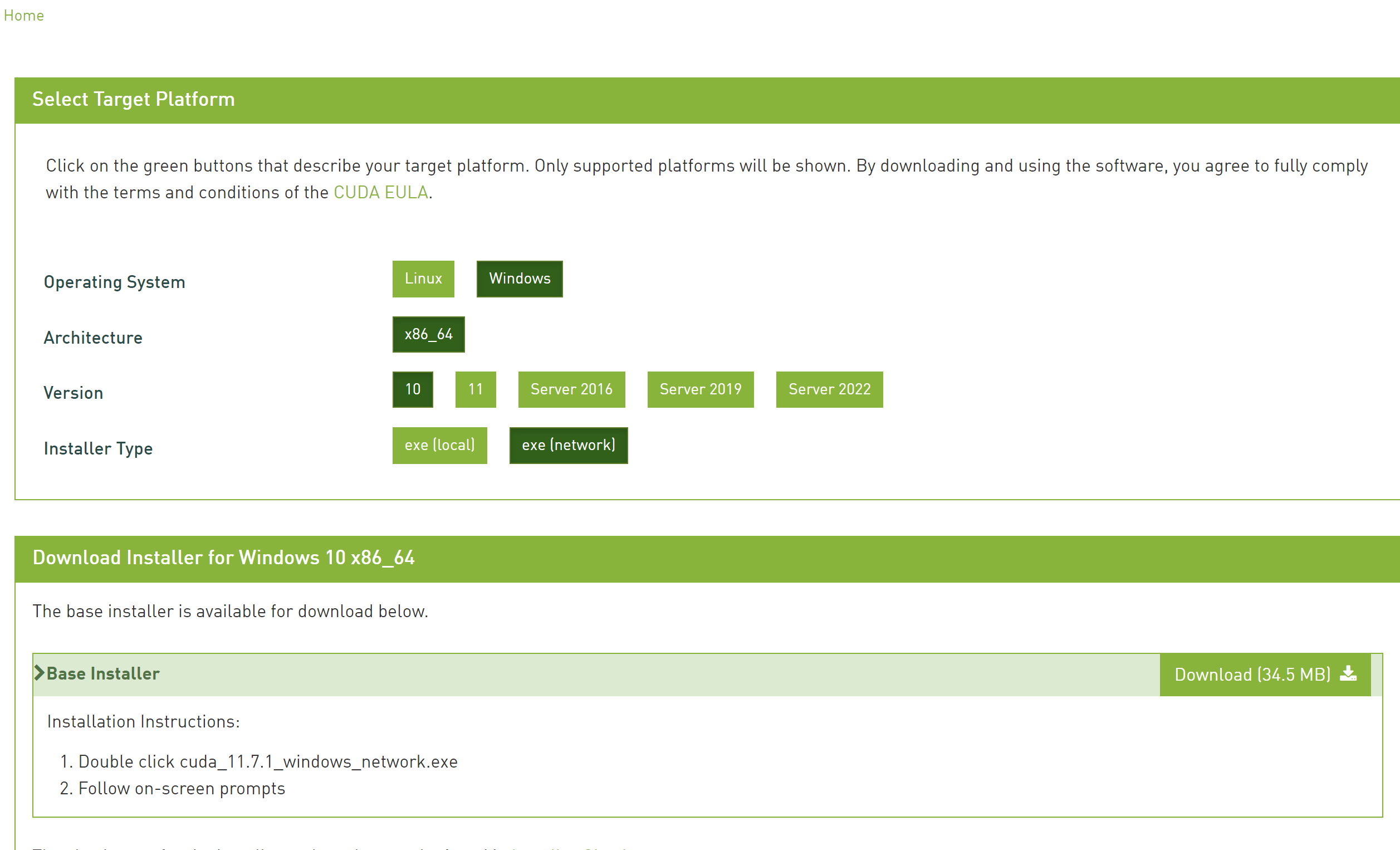

2.CUDAのインストール

- https://developer.nvidia.com/cuda-downloads を開き、環境にあったインストーラをダウンロードします。

![]()

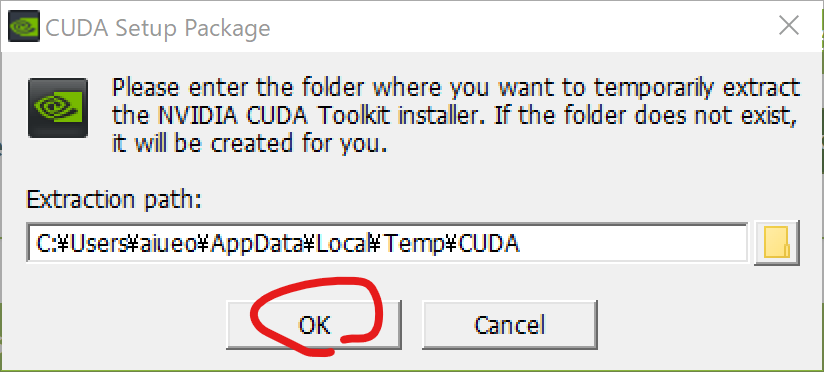

- インストーラを起動します。OKをクリックします。

![]()

- 同意して続行するをクリックします。

![]()

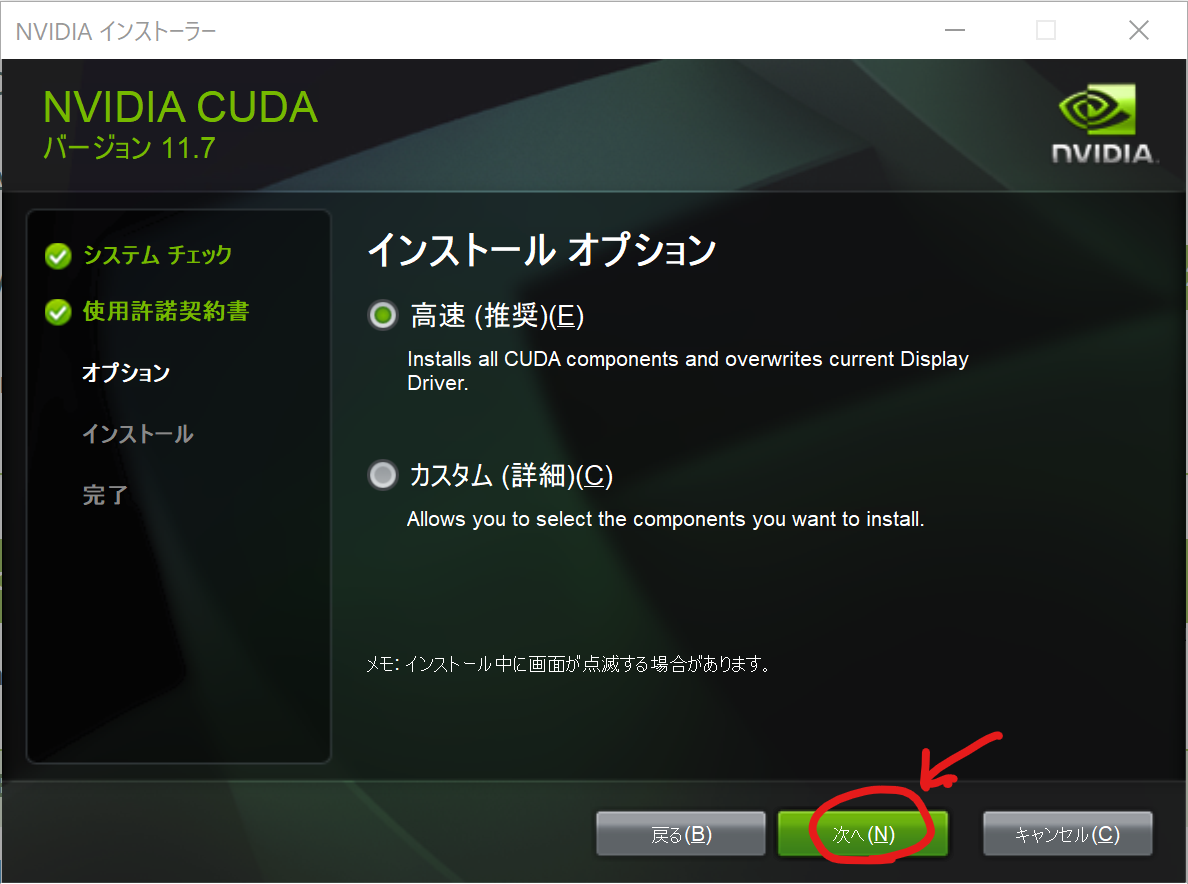

- 次へをクリックします。

![]()

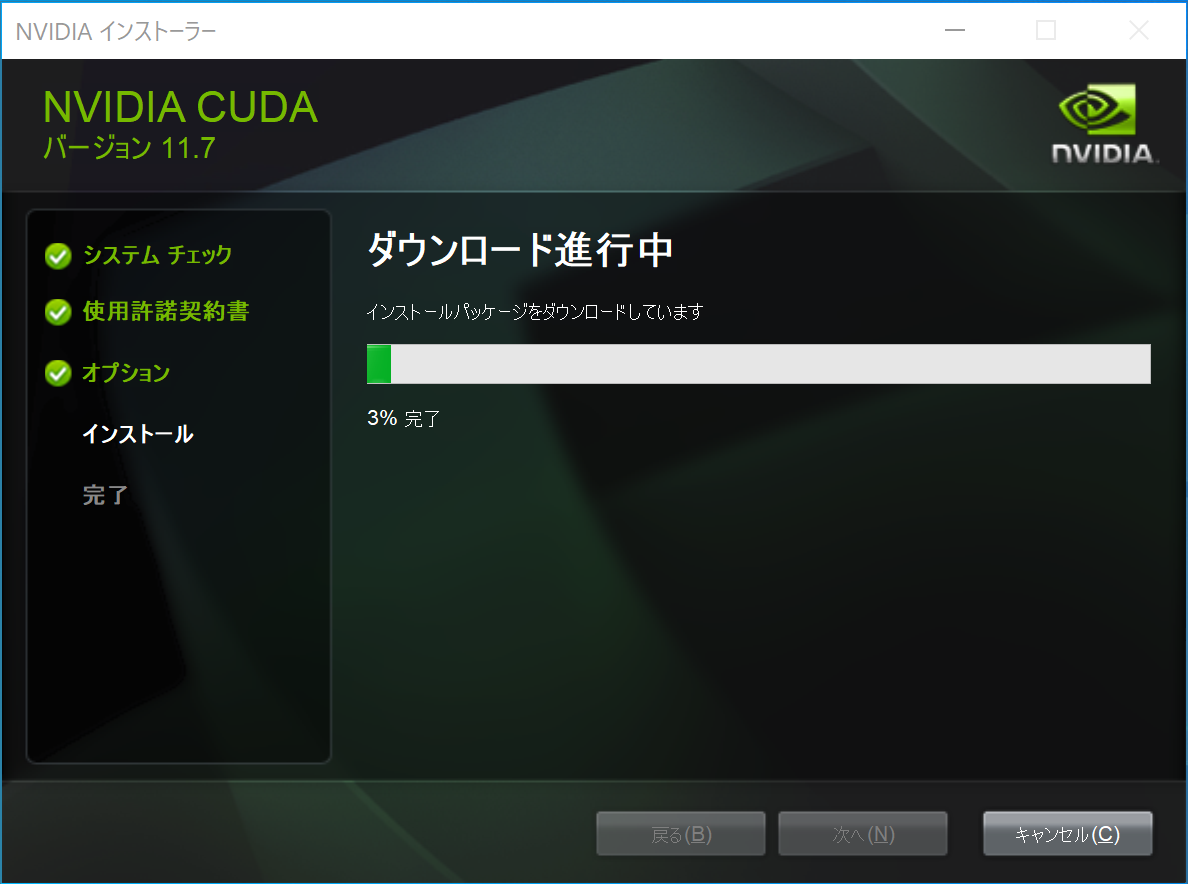

- インストールが完了するまで待ちます。

![]()

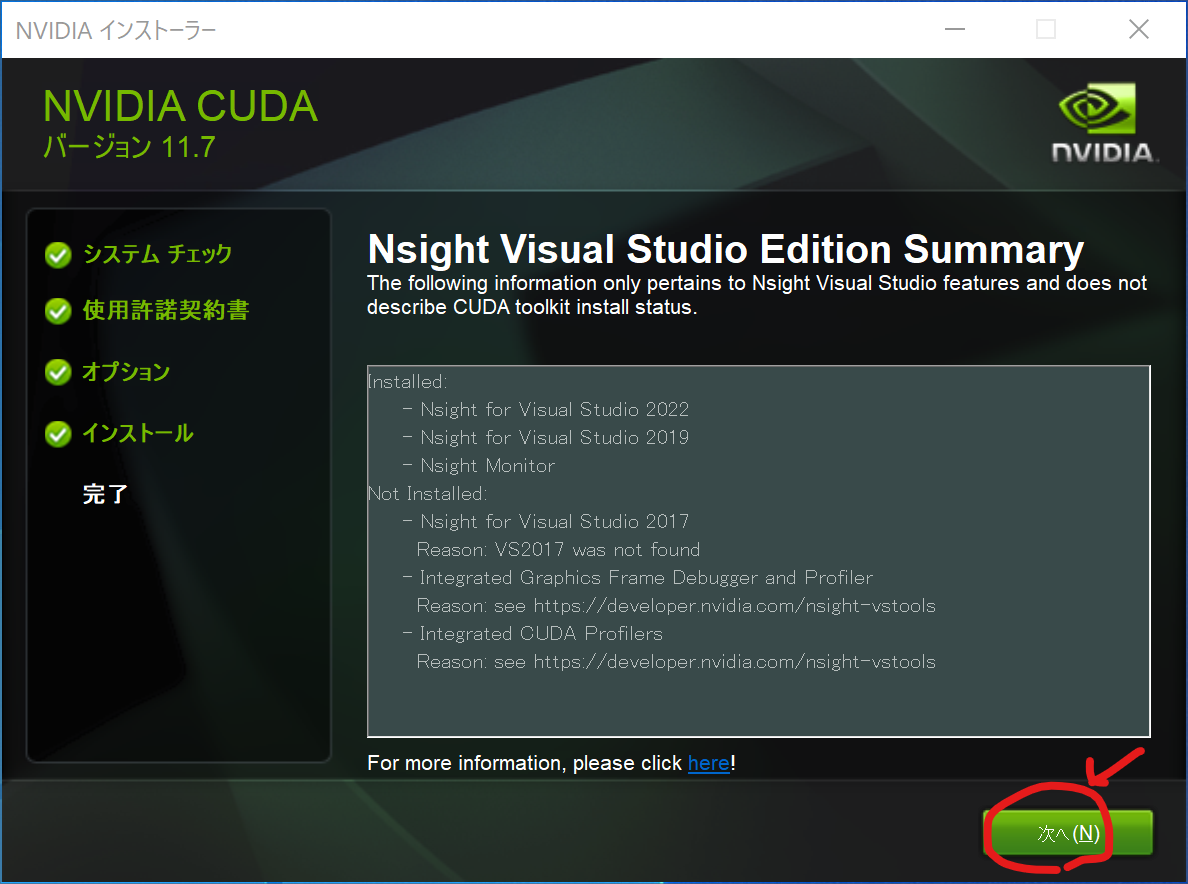

- インストールが完了すると、以下の画面になります。次へをクリックします。

![]()

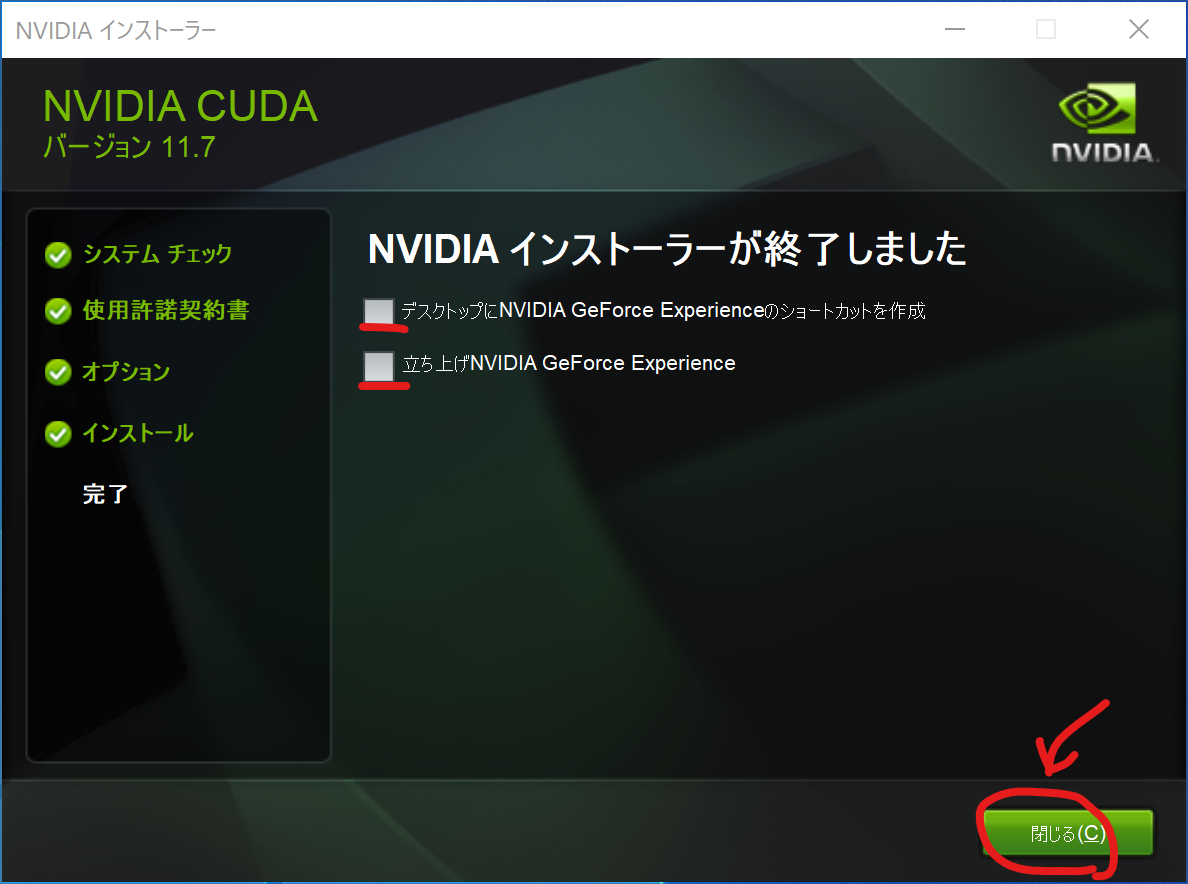

- チェックボックスのチェックをはずし、閉じるをクリックします。

![]()

3.Dockerのインストール

-

- https://www.docker.com/products/docker-desktop/ を開き、Windows をクリックします。

![]()

- ダウンロードが完了したら、ファイルをクリックします。

![]()

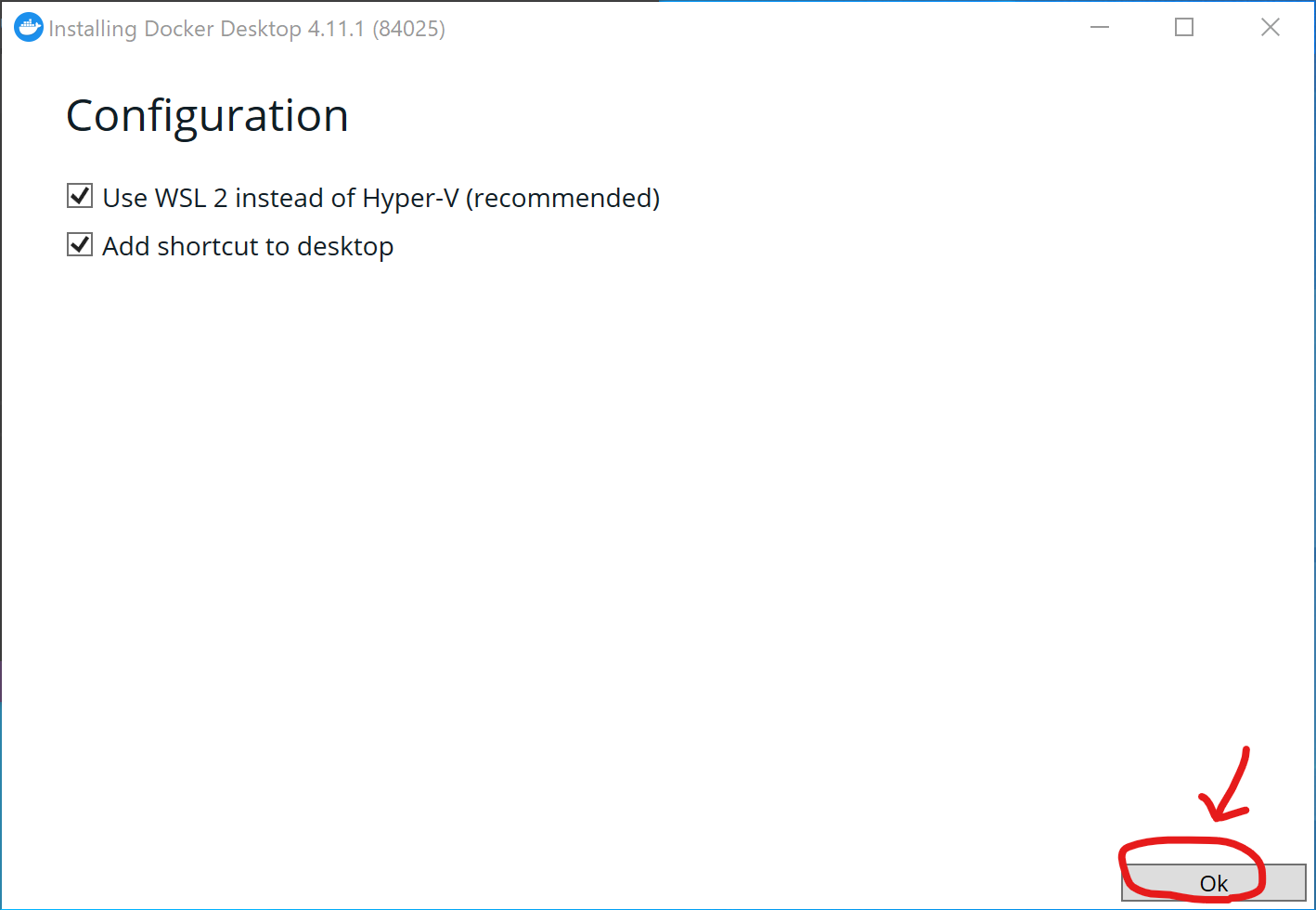

- Ok をクリックします。

![]()

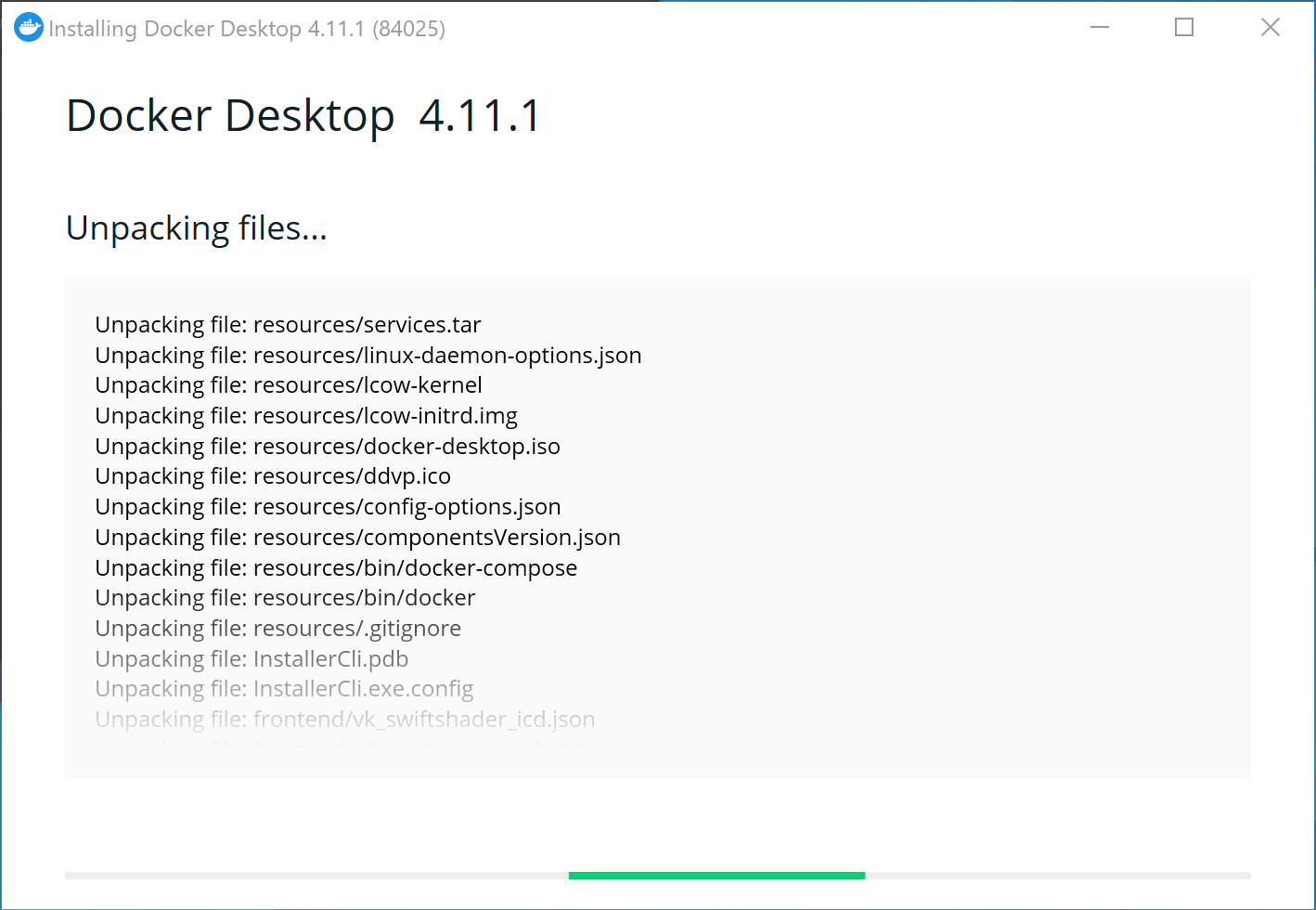

- インストールが開始されます。しばらく待ちます。

![]()

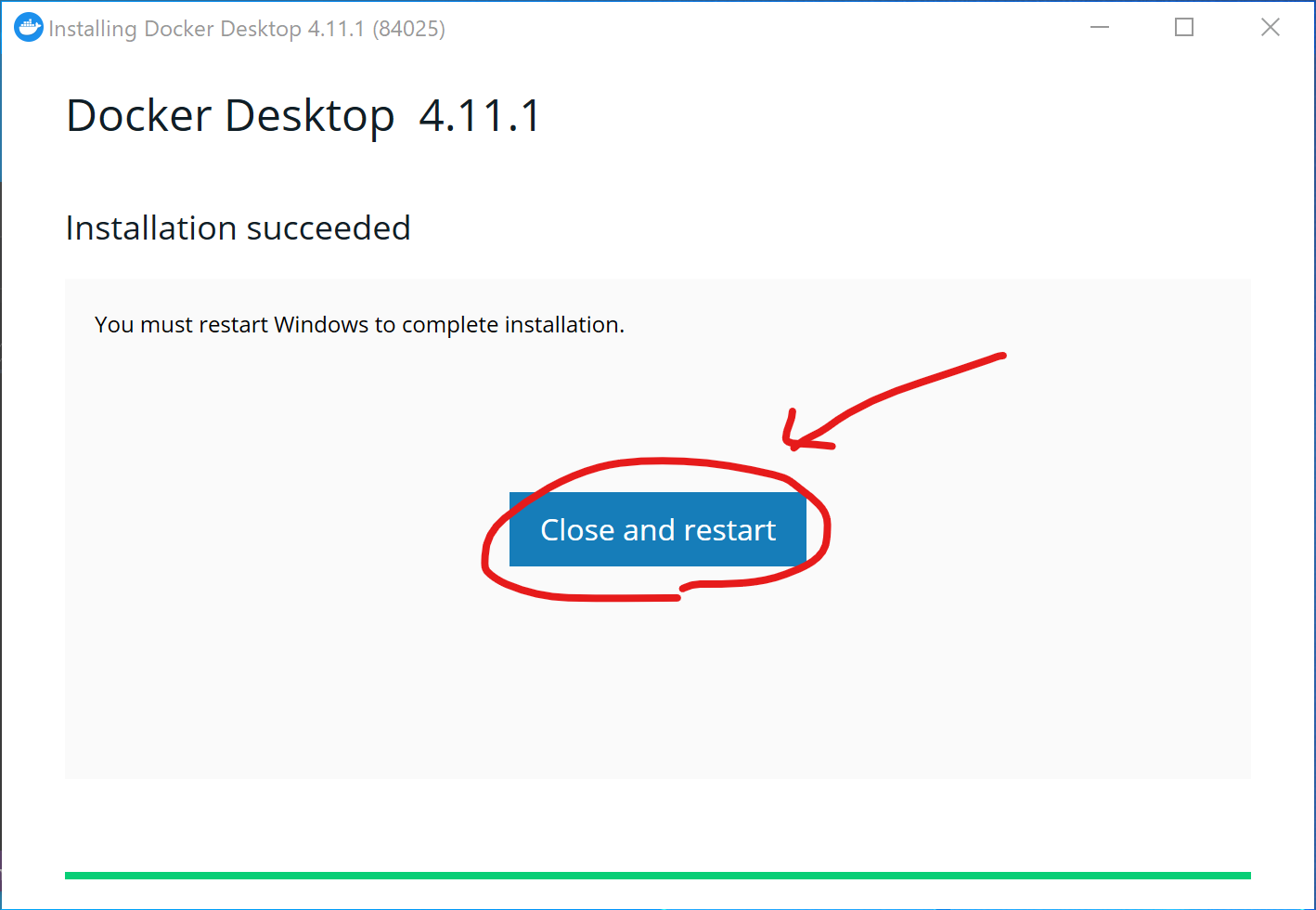

- Close and restart をクリックします。

![]()

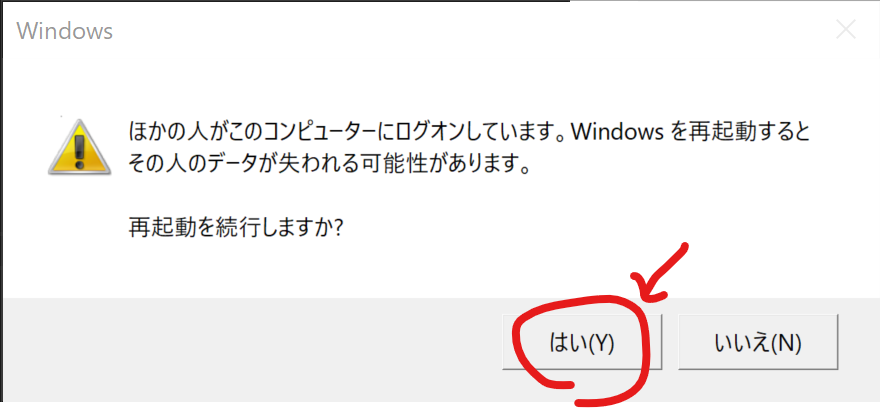

- 再起動しても問題ない状態にしたあと、はい をクリックします。

![]()

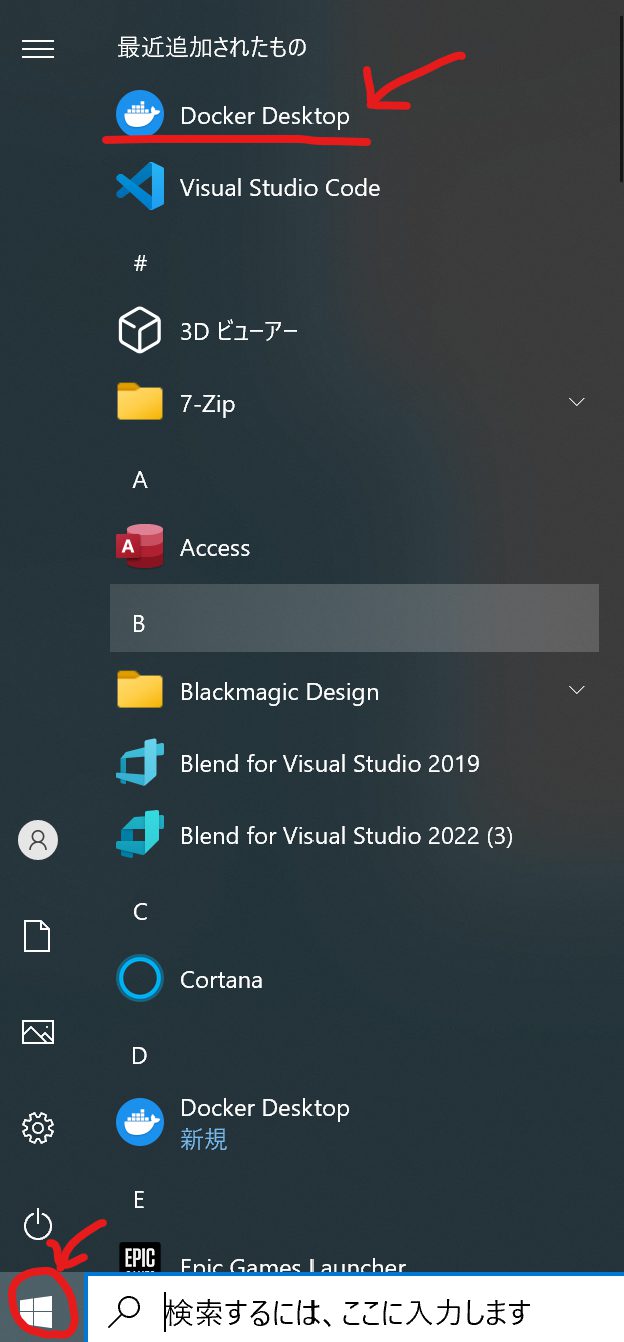

- 再起動完了後、ウィンドウズマークをクリックし、Docker Desktop をクリックします。

![]()

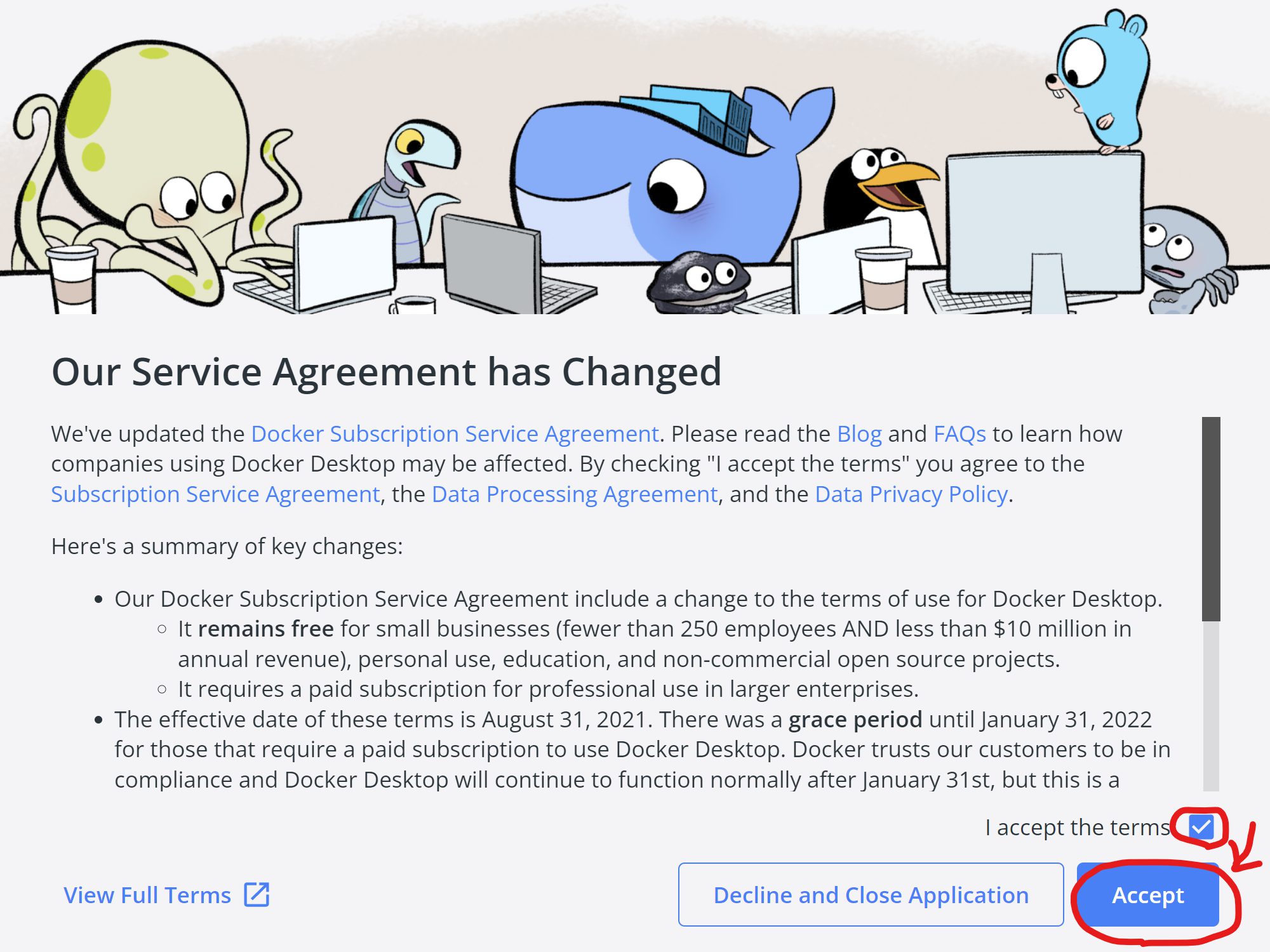

- I accept the terms にチェックをいれ、Accept をクリックします。

![]()

- Skip tutorial をクリックします。

![]()

- ウィンドウ右上の×をクリックしてウィンドウを閉じます。

![]()

- https://www.docker.com/products/docker-desktop/ を開き、Windows をクリックします。

4.Visual Studio Codeのインストール

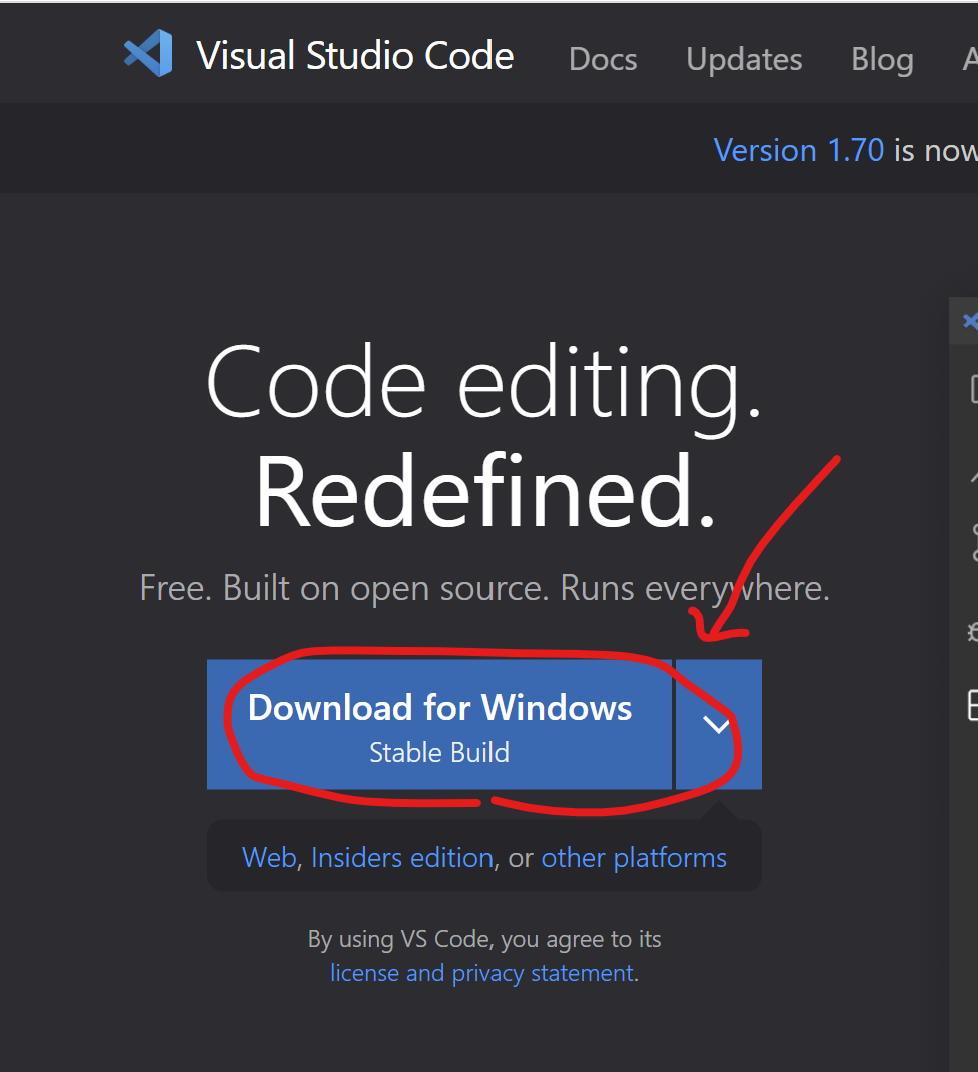

- https://code.visualstudio.com/ を開き、Download for Windows をクリックします。

![]()

- ダウンロードが完了したら、ファイルをクリックします。

![]()

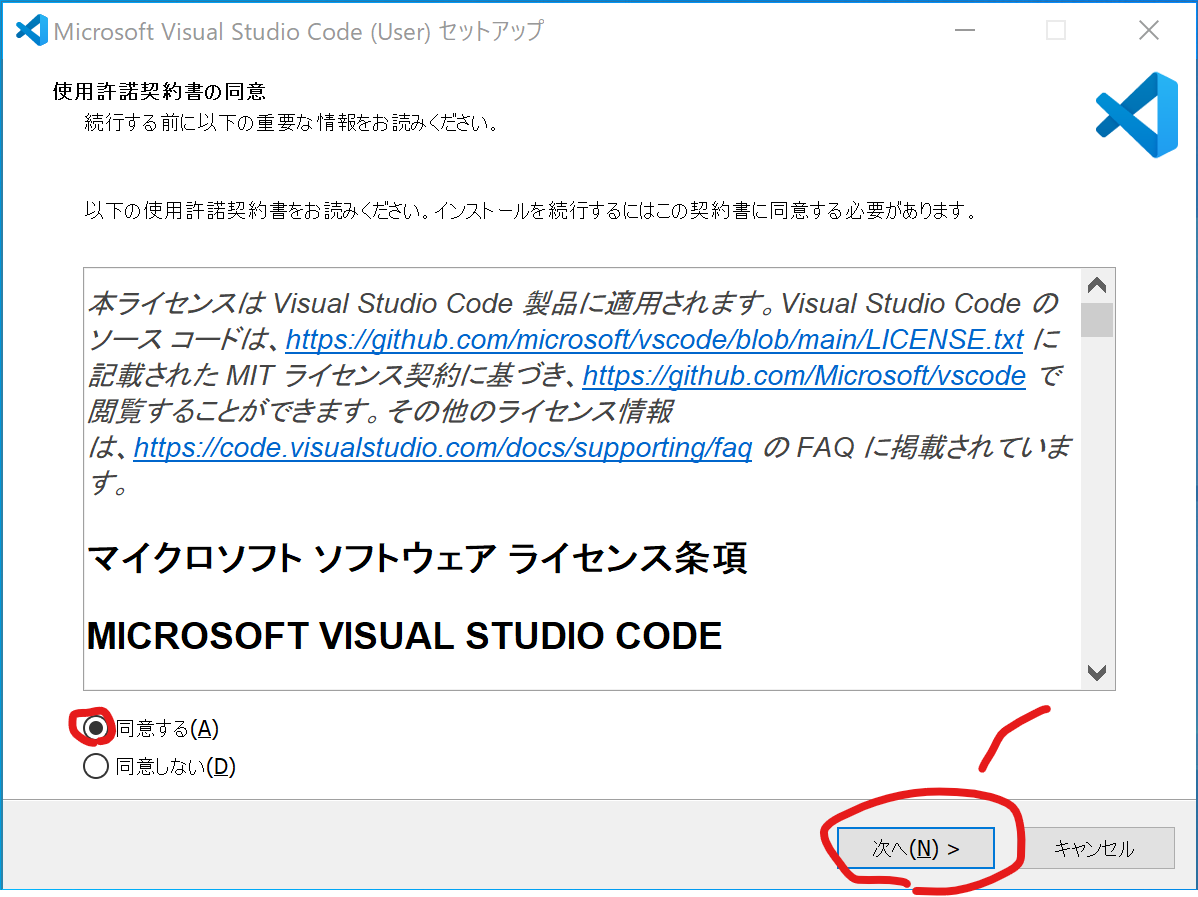

- 同意するにチェックをいれ、次へをクリックします。

![]()

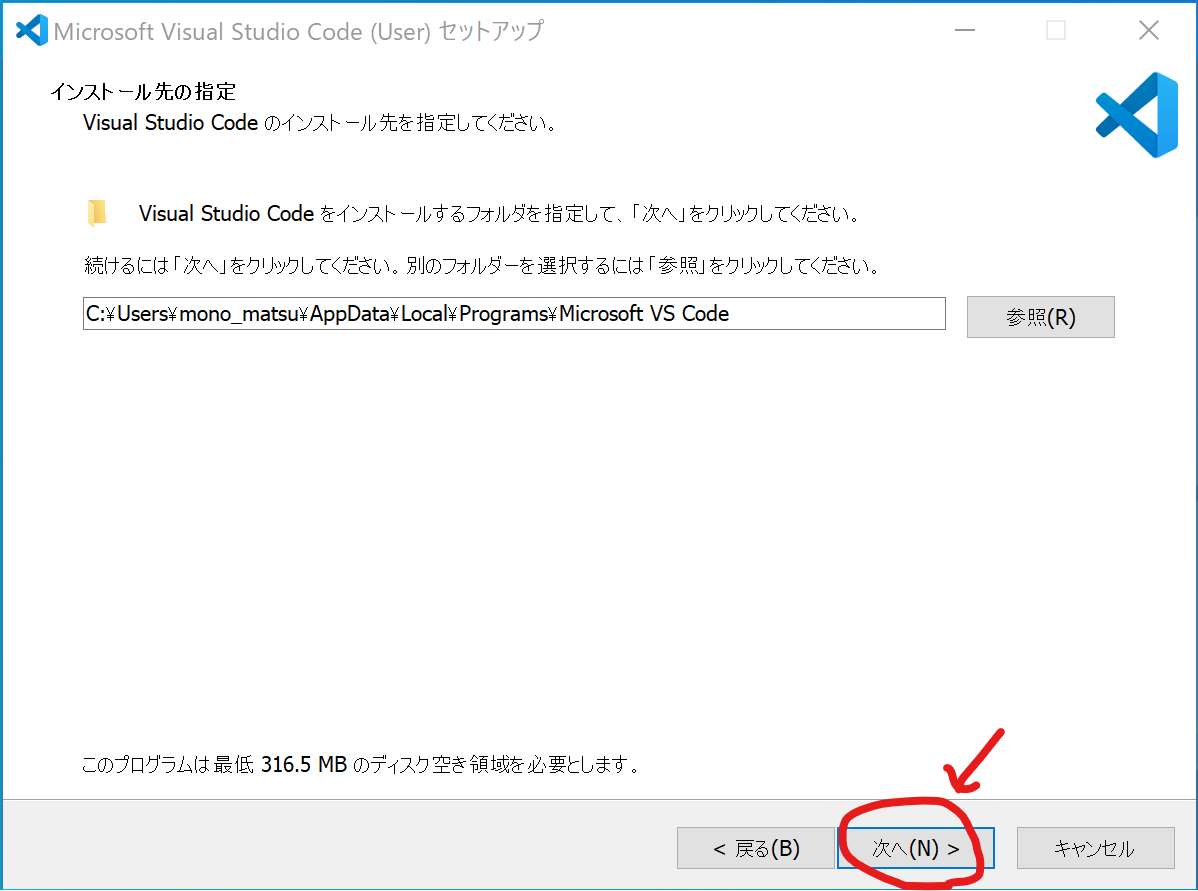

- 次へをクリックします。

![]()

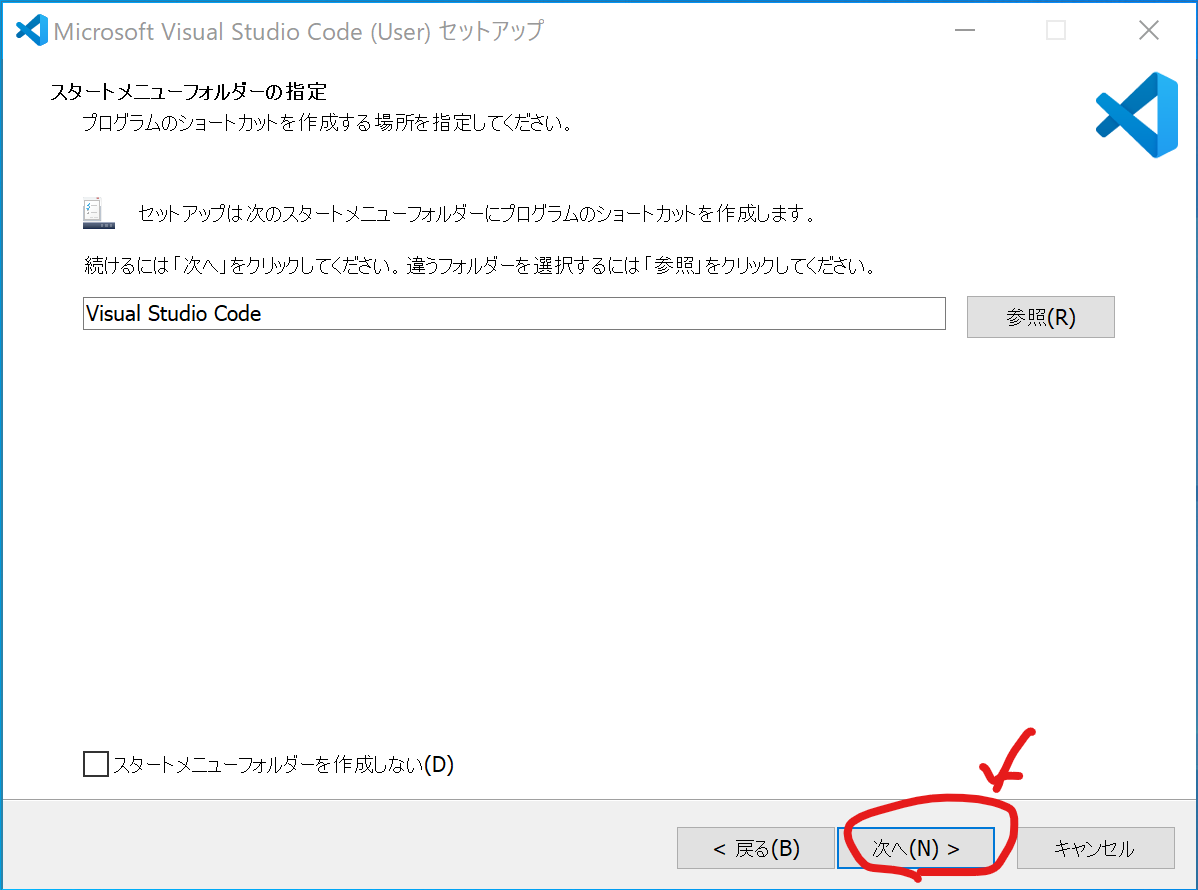

- 次へをクリックします。

![]()

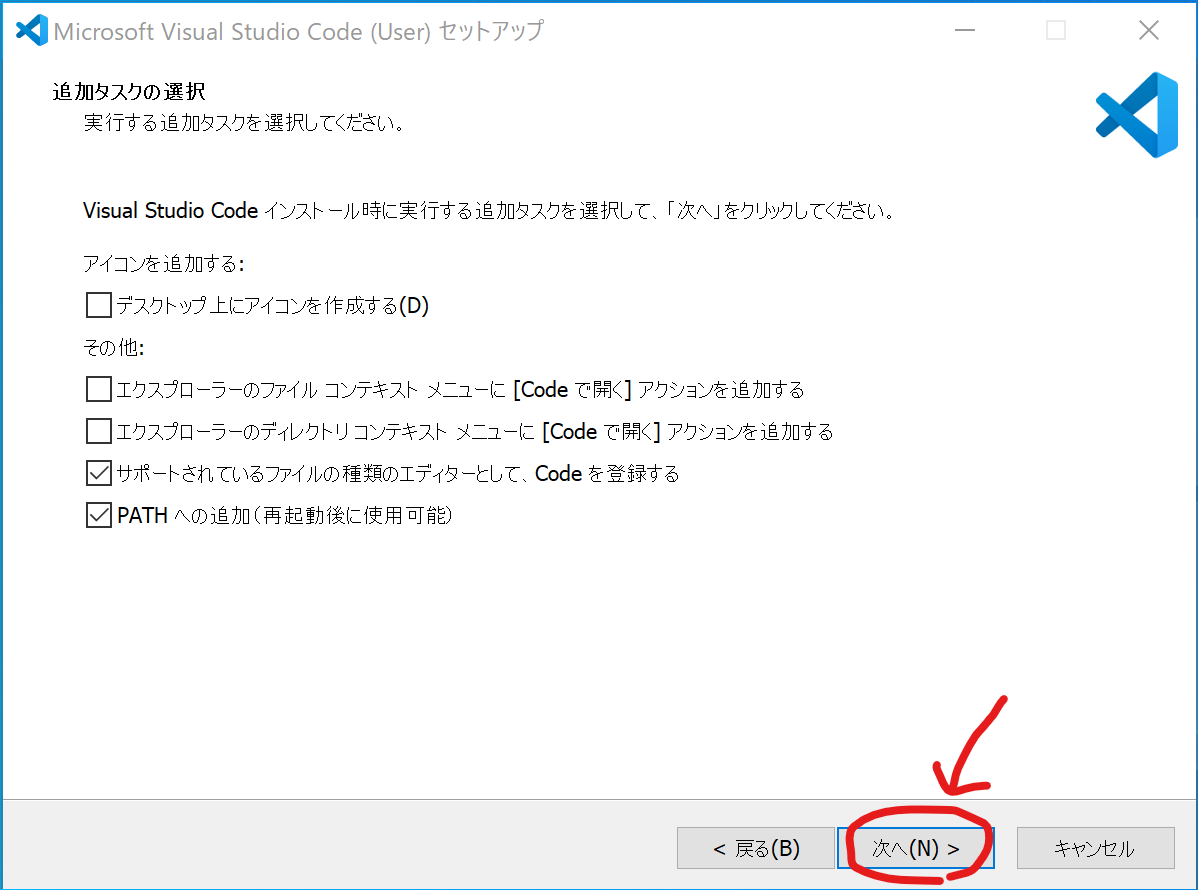

- 次へをクリックします。

![]()

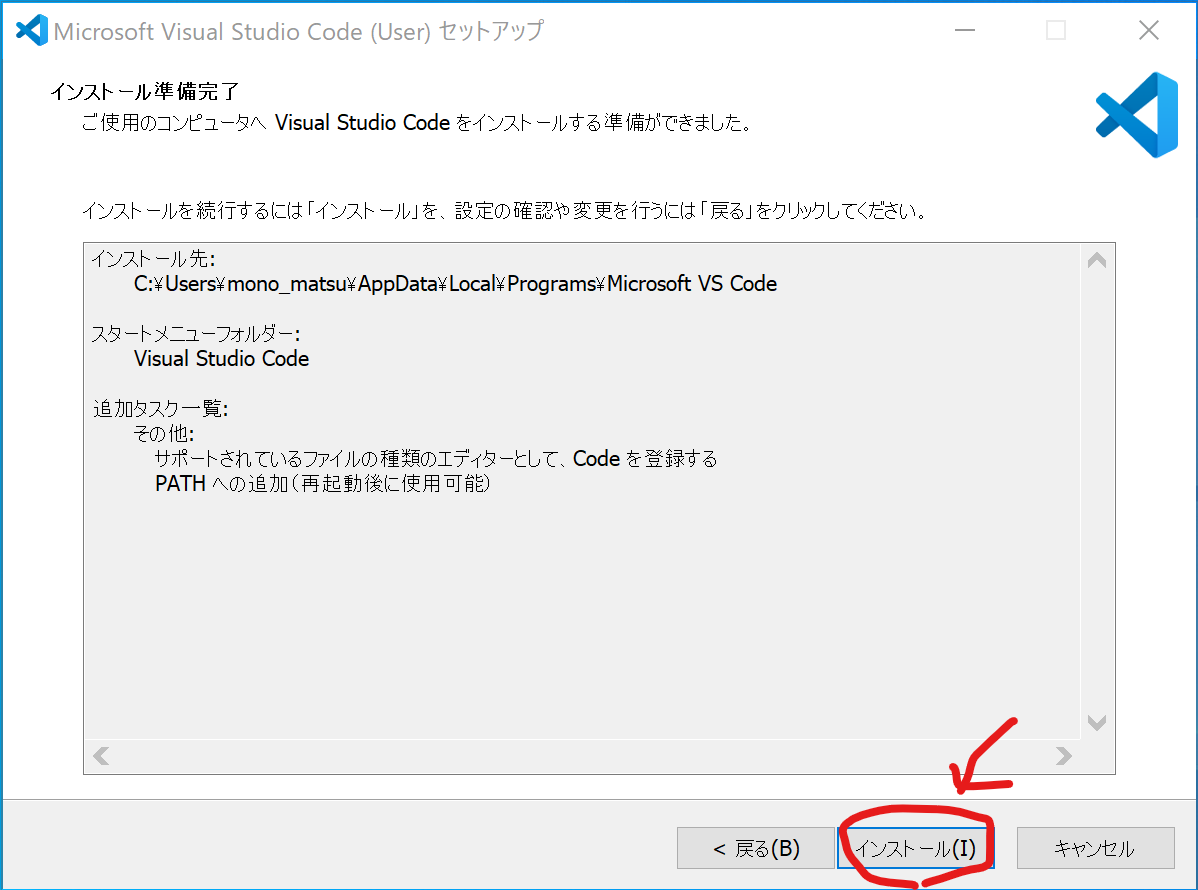

- インストールをクリックします。

![]()

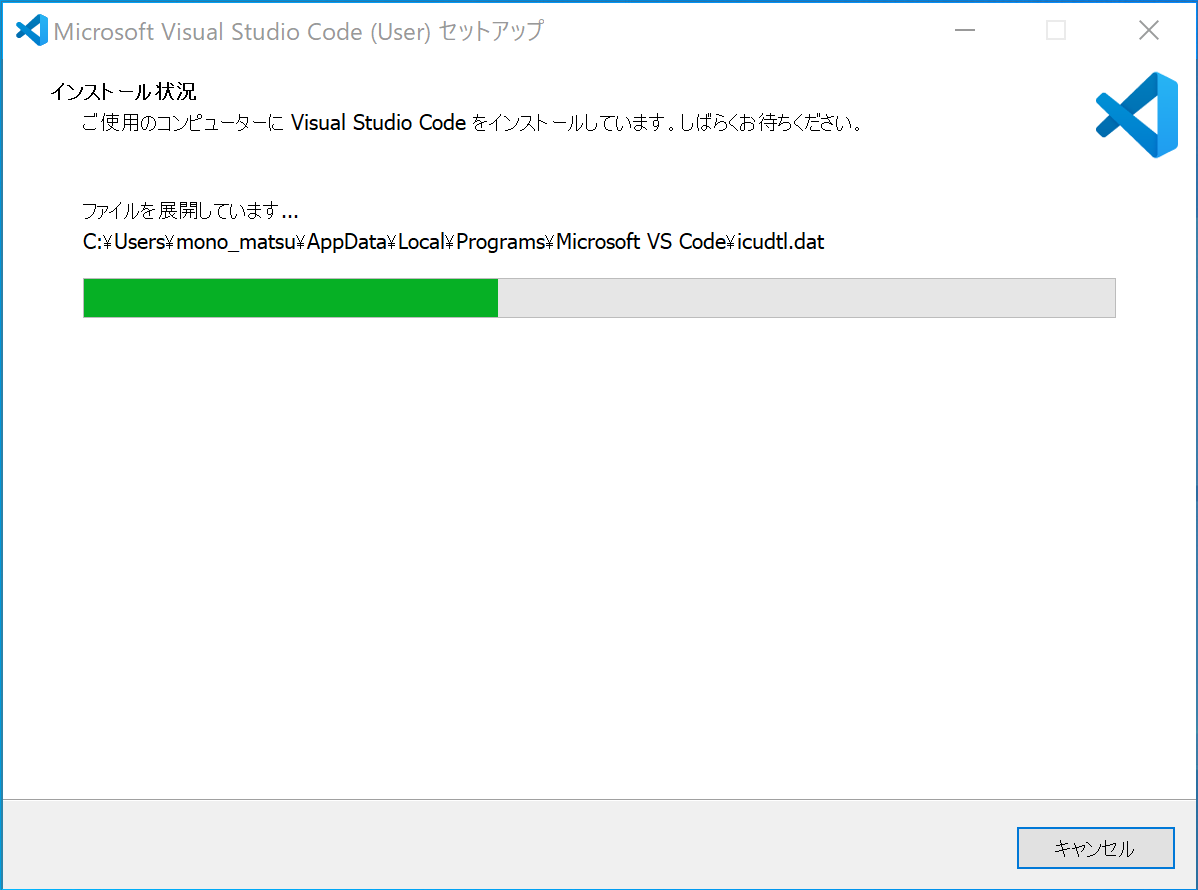

- インストールが完了するまでしばらく待ちます。

![]()

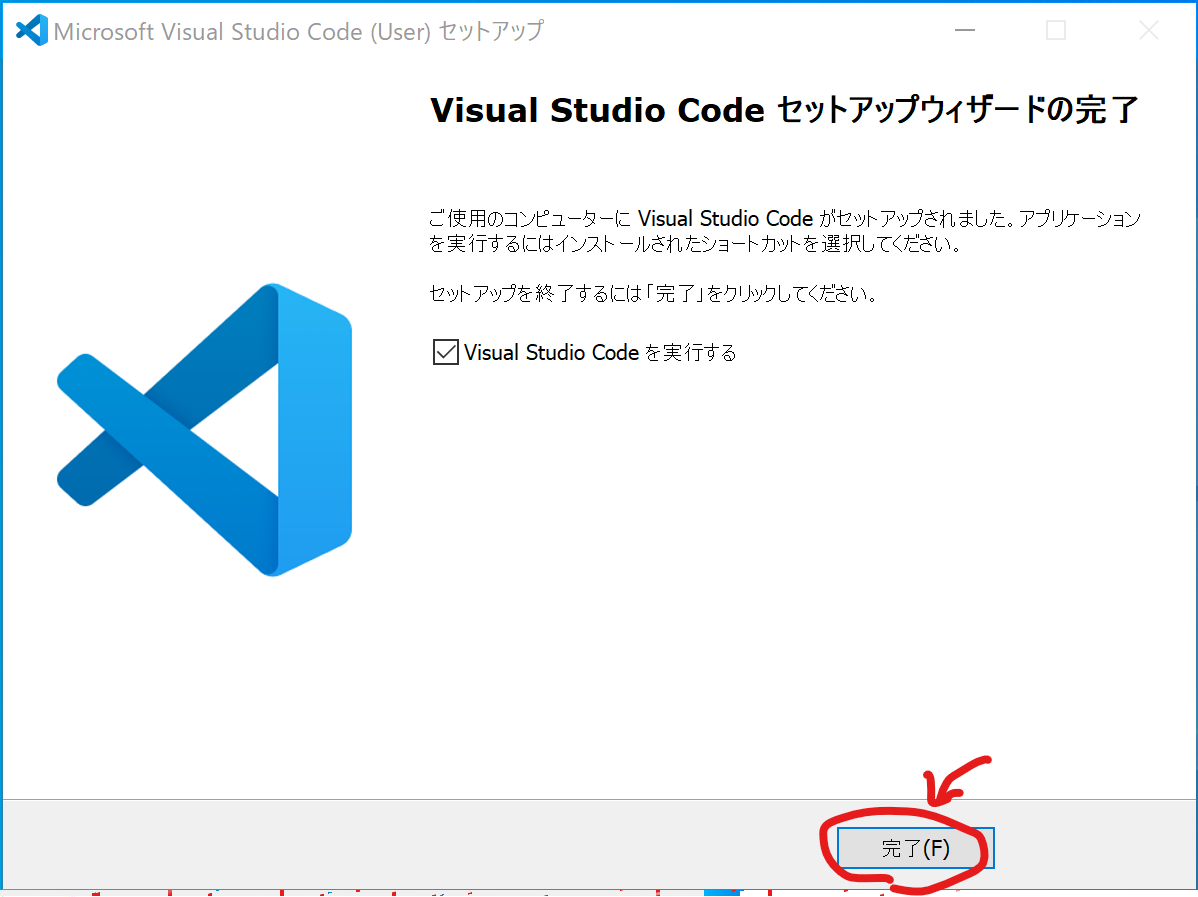

- 完了をクリックします。

![]()

5.Visual Studio Codeに拡張機能をインストール

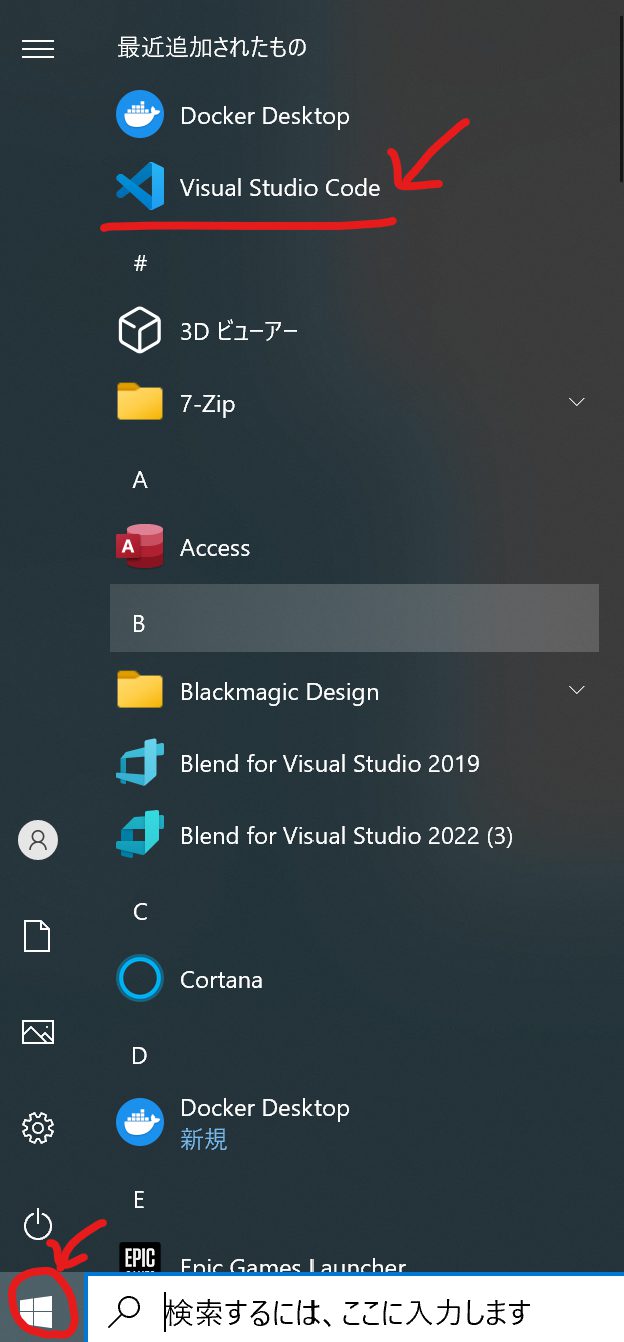

- ウィンドウズマークをクリックし、Visual Studio Code をクリックします。

![]()

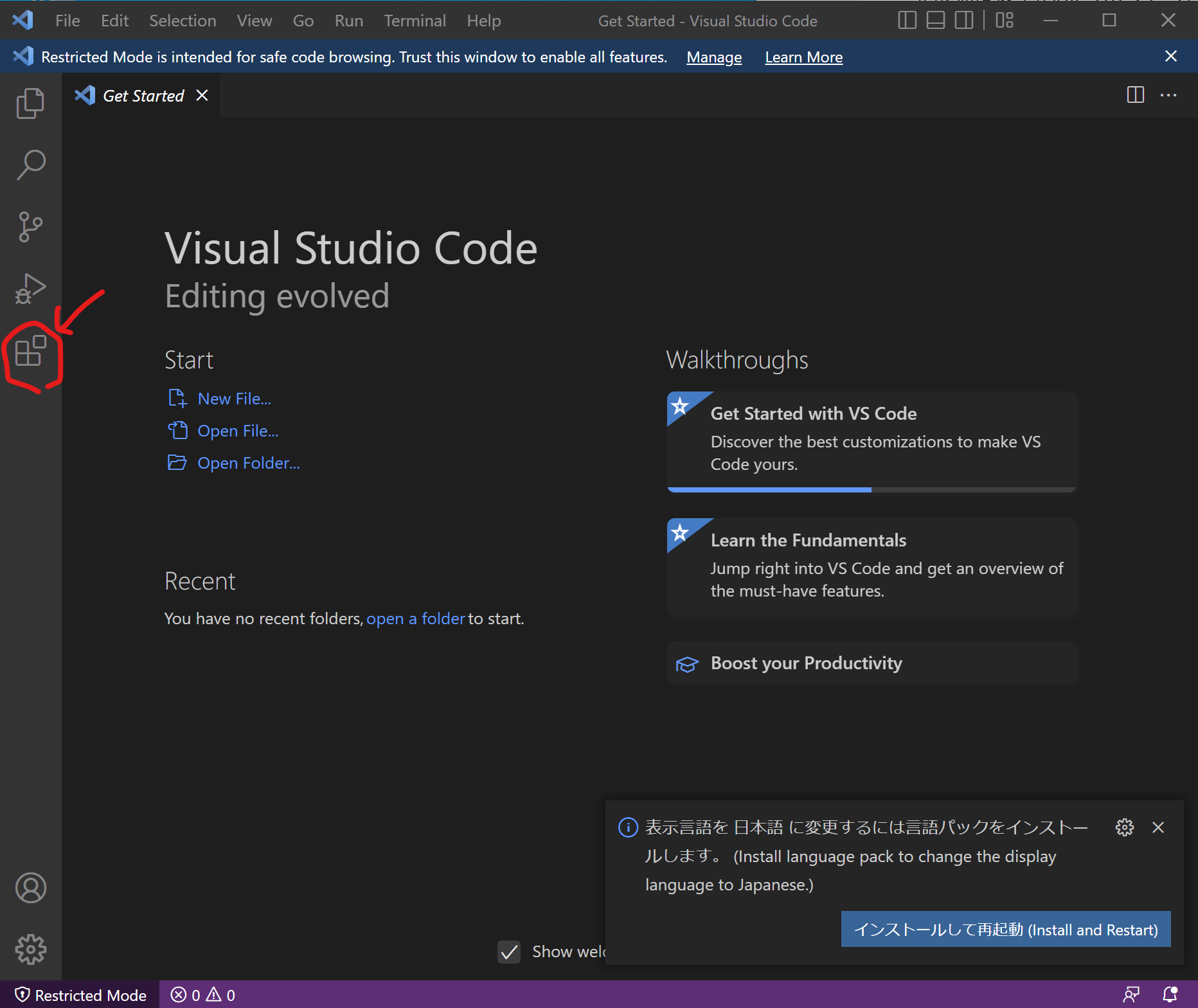

- ウィンドウ左のExtensionsをクリックします。

![]()

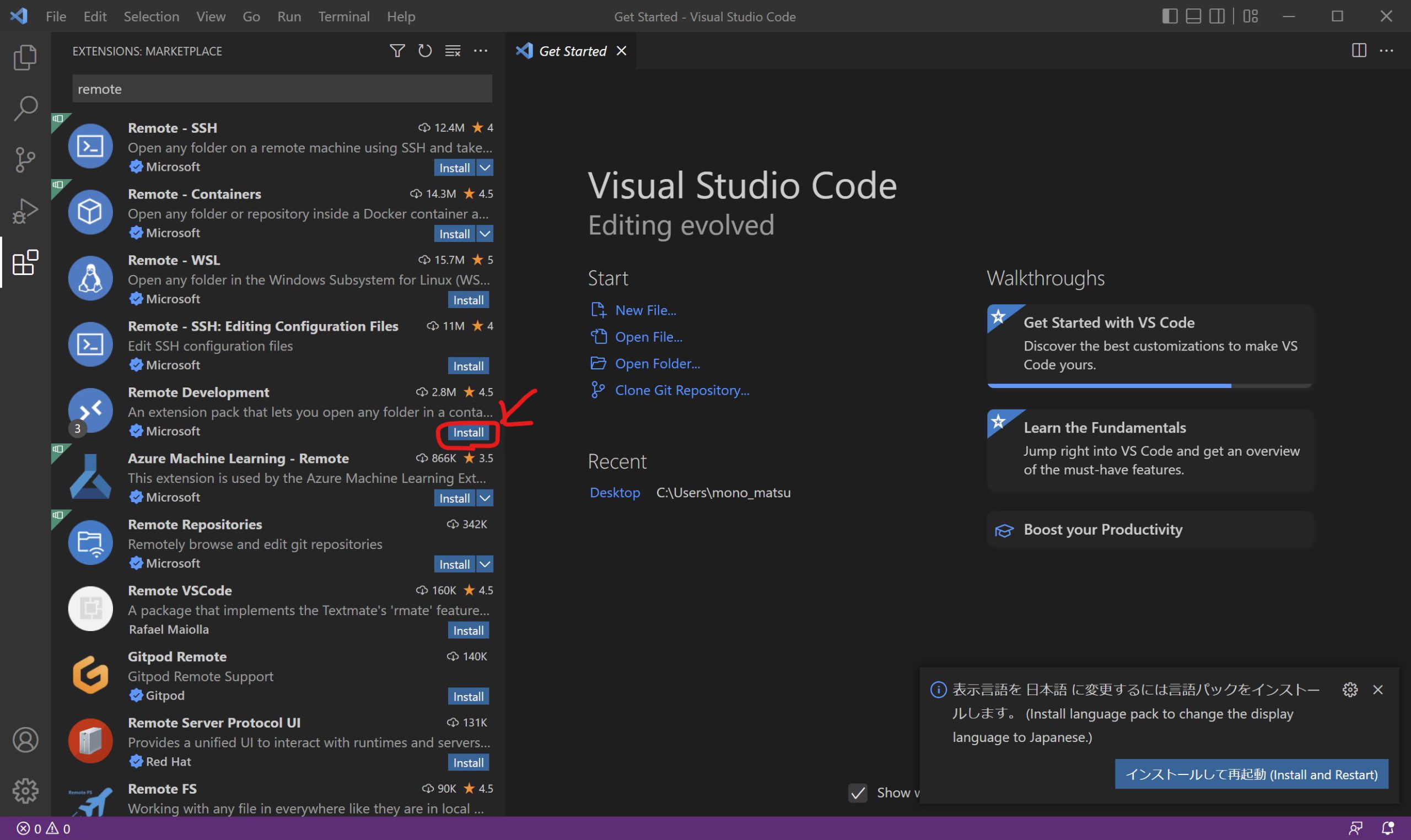

- 左上の検索窓に remote と入力し、表示された Remote Development をインストールします。

![]()

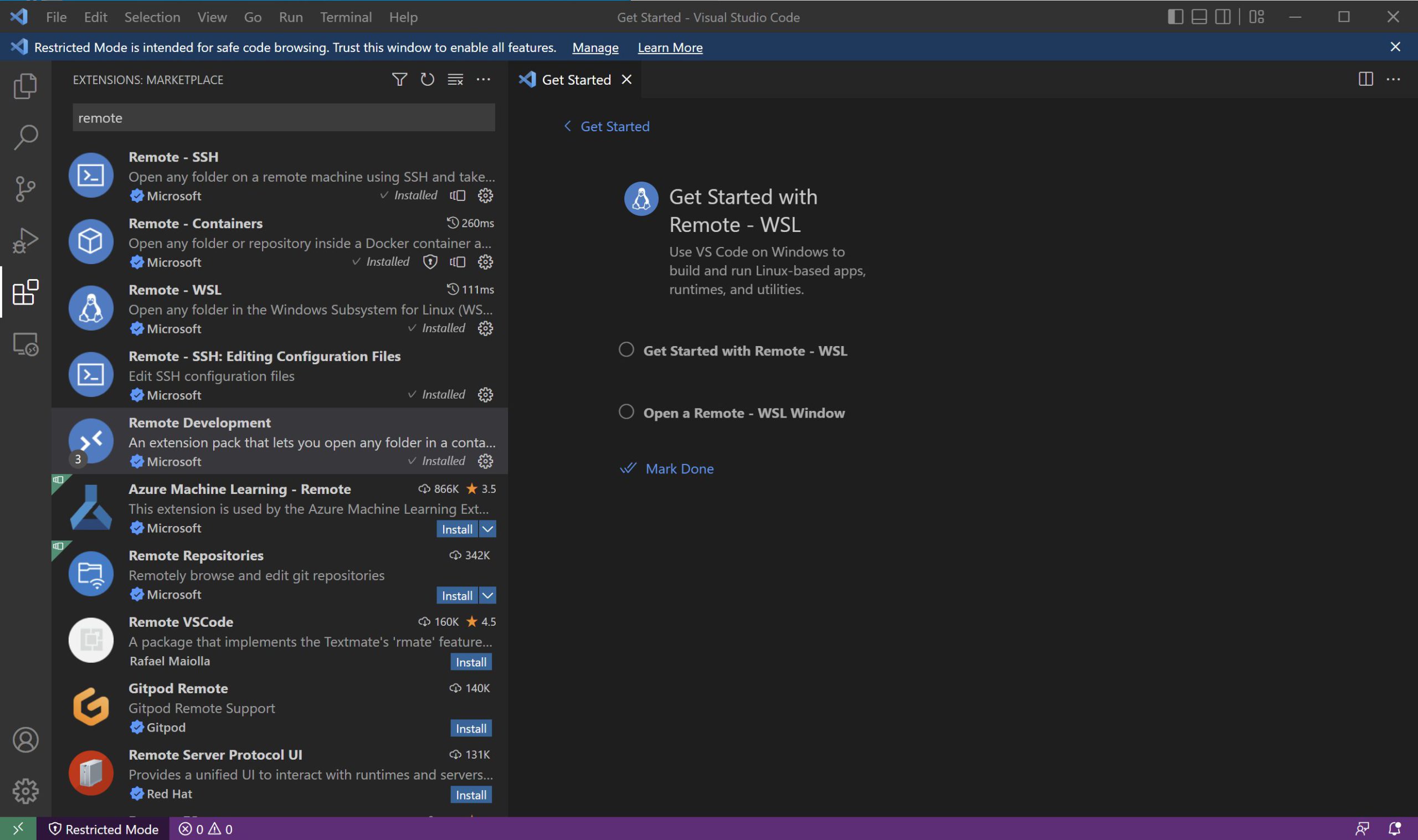

- インストールが完了すると以下の画面になります。

![]()

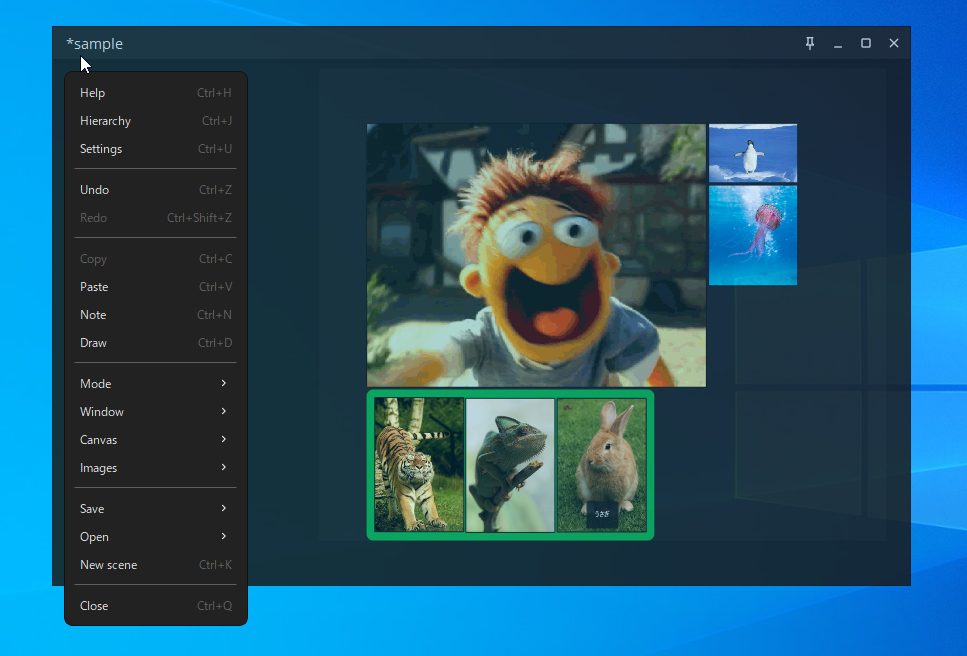

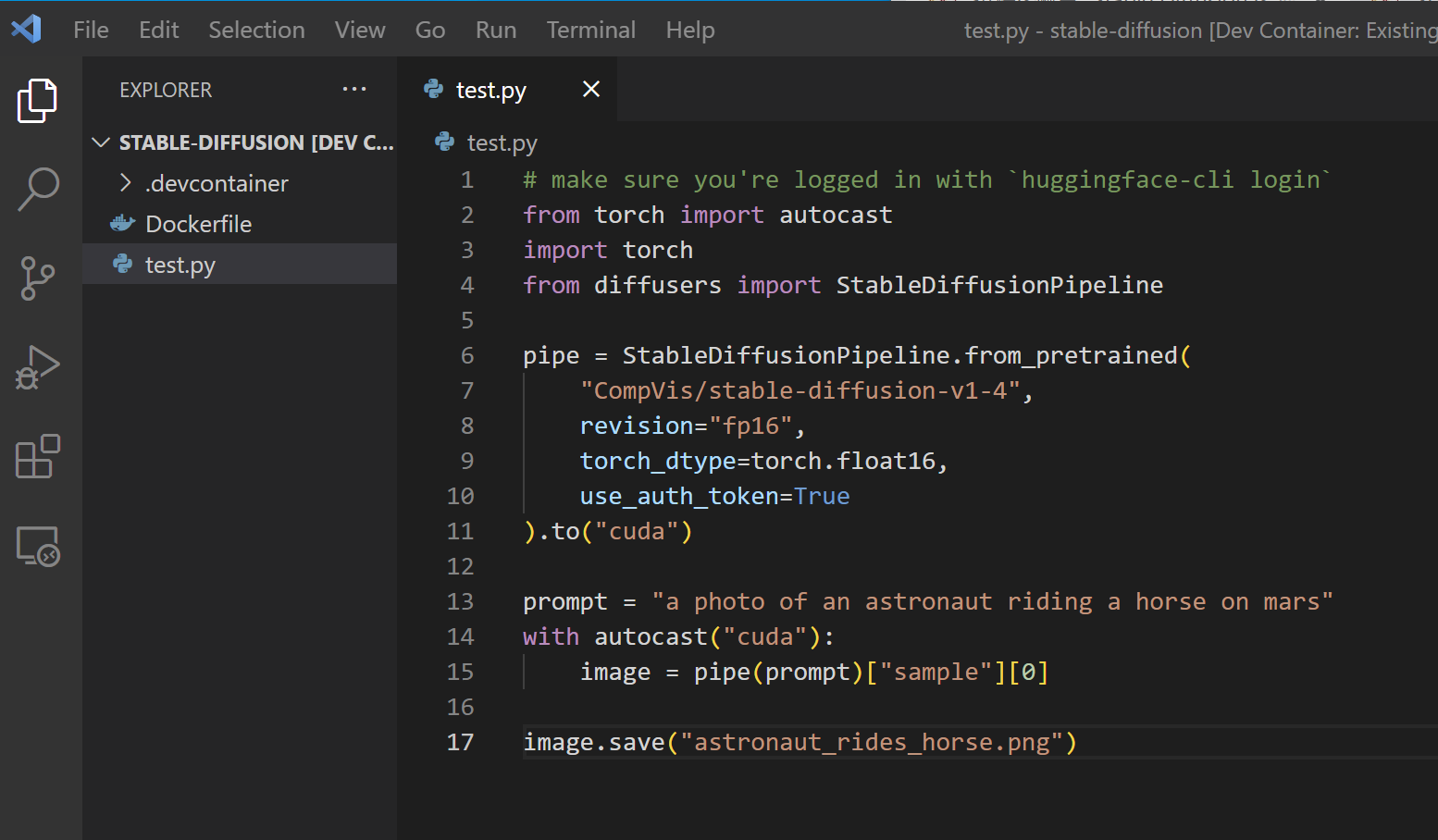

6.Stable Diffusionで画像生成

- 左メニューのExplorerをクリックし、Open Folder をクリックします。

![]()

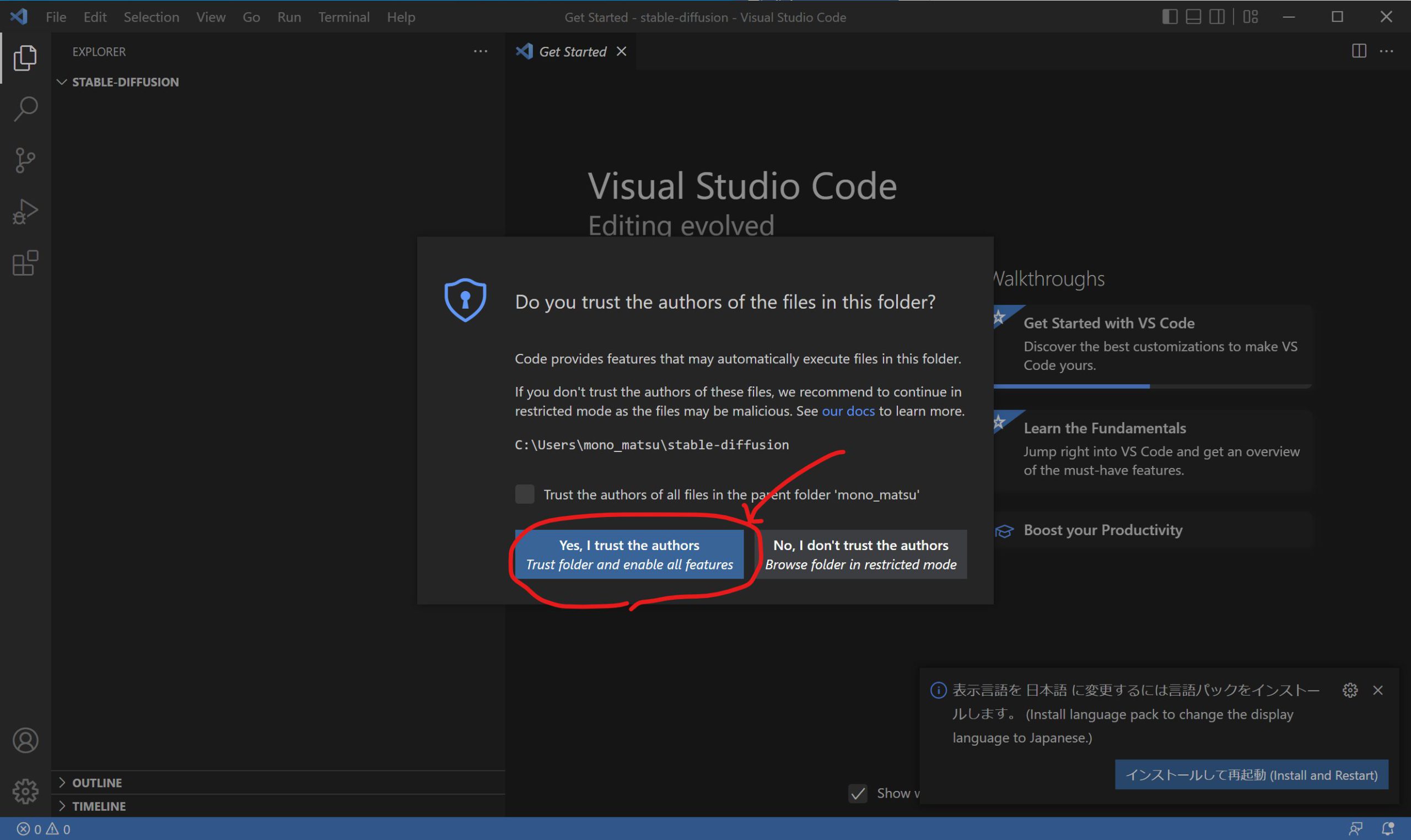

- 適当なフォルダを開きます。この例ではstable-diffusionフォルダを作りました。stable-diffusionフォルダを選択した状態で、フォルダーの選択をクリックします。

![]()

- Yes, I trust the authorsをクリックします。

![]()

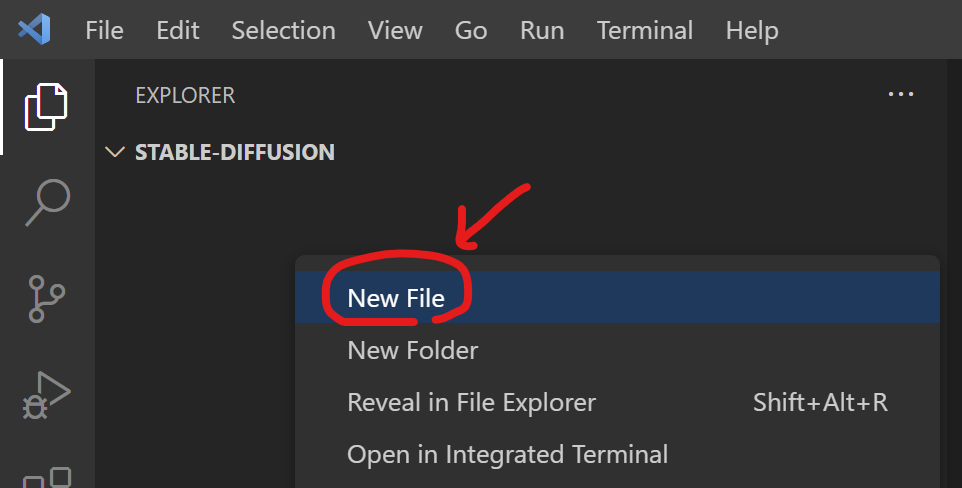

- マウスを右クリックし、New Fileをクリックします。

![]()

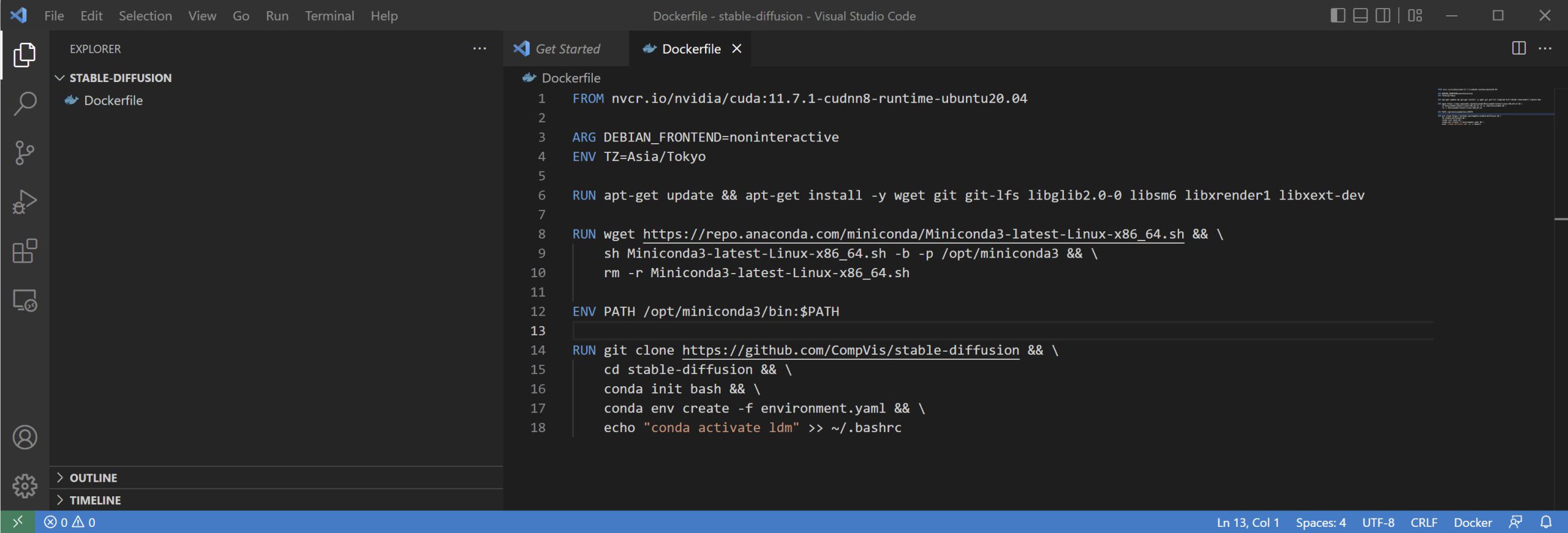

- ファイル名をDockerfileにし、下記の内容を記入します。

FROM nvcr.io/nvidia/cuda:11.7.1-cudnn8-runtime-ubuntu20.04 ARG DEBIAN_FRONTEND=noninteractive ENV TZ=Asia/Tokyo RUN apt-get update && apt-get install -y wget git git-lfs libglib2.0-0 libsm6 libxrender1 libxext-dev RUN wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh && \ sh Miniconda3-latest-Linux-x86_64.sh -b -p /opt/miniconda3 && \ rm -r Miniconda3-latest-Linux-x86_64.sh ENV PATH /opt/miniconda3/bin:$PATH RUN git clone https://github.com/CompVis/stable-diffusion && \ cd stable-diffusion && \ conda init bash && \ conda env create -f environment.yaml && \ echo "conda activate ldm" >> ~/.bashrc![]()

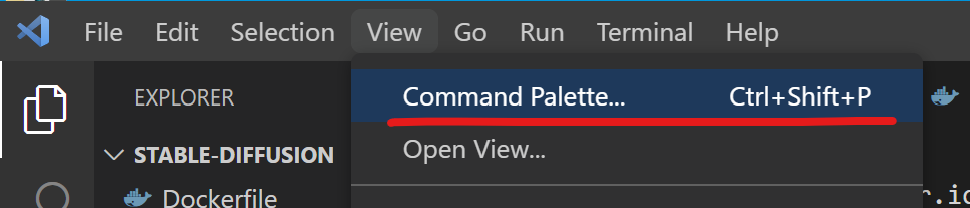

- View→Command Paletteをクリックします。

![]()

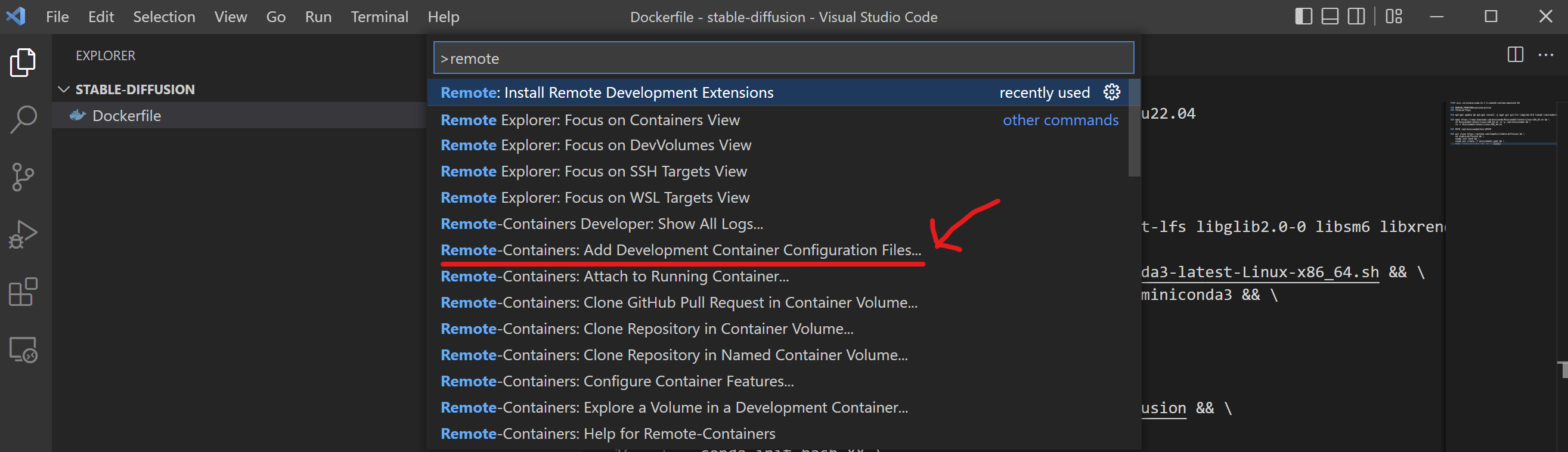

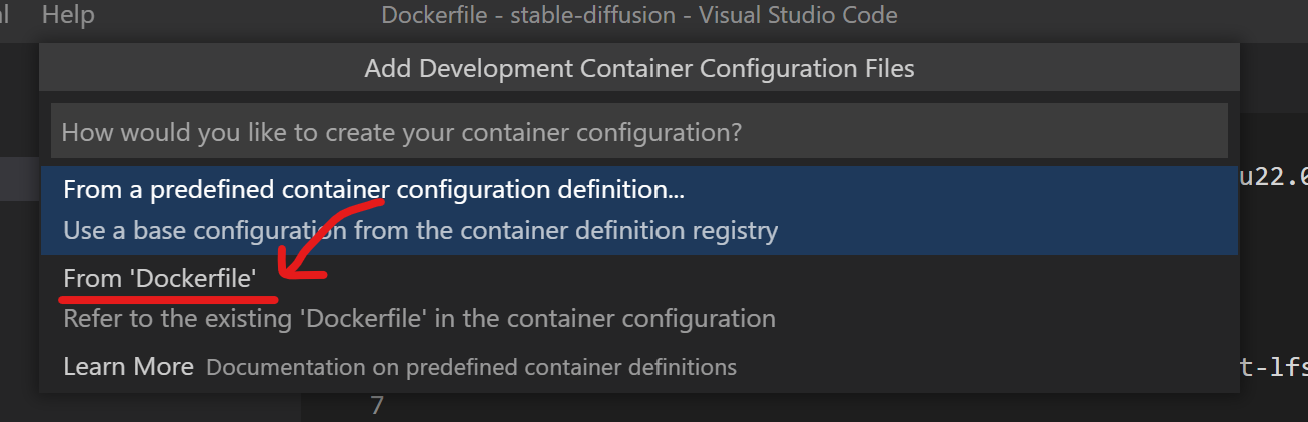

- 検索窓に remote と入力し、表示されるリストの中からRemote-Containers: Add Development Container Configuration Files...をクリックします。

![]()

- From 'Dockerfile'をクリックします。

![]()

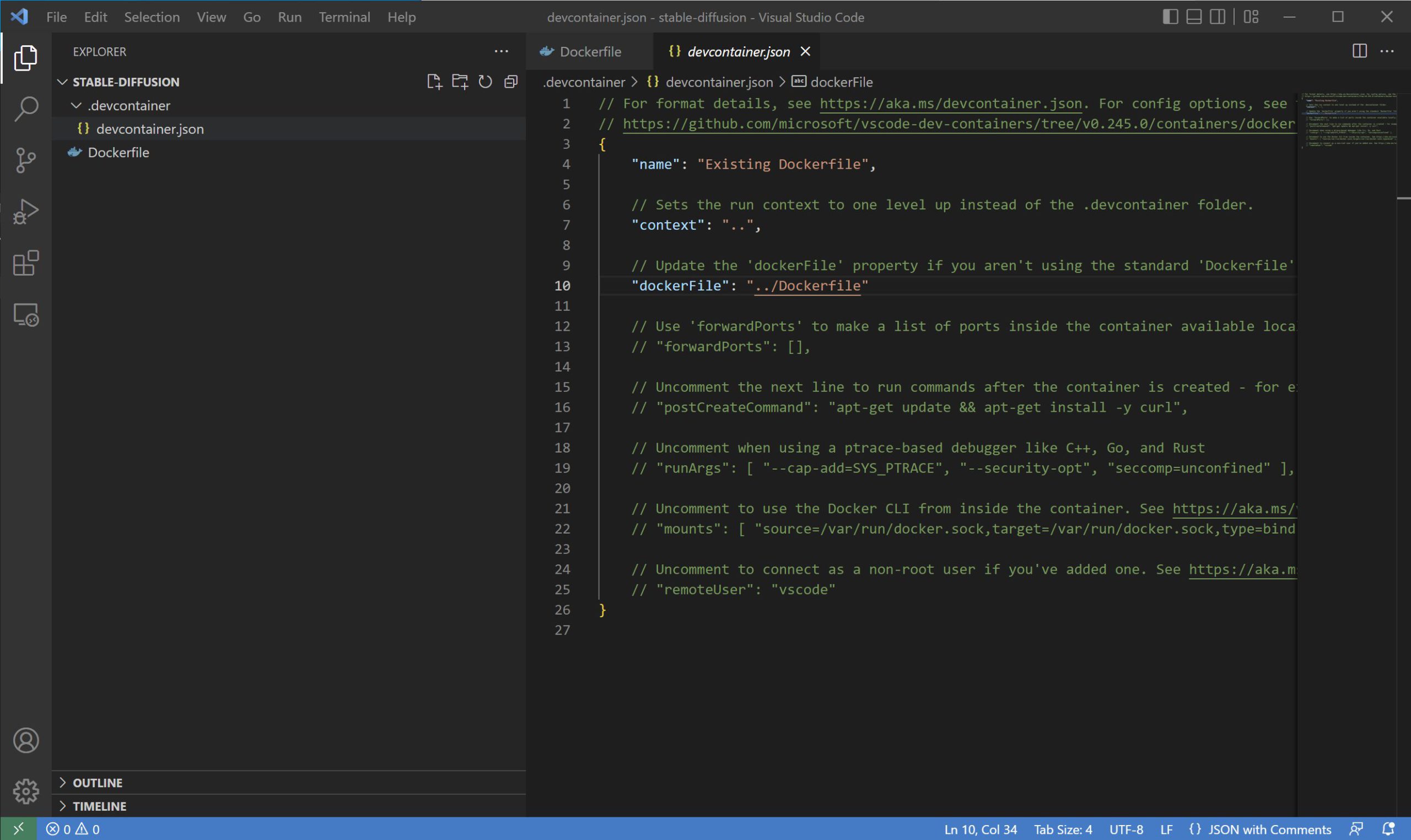

- devcontainer.jsonが生成されます。

![]()

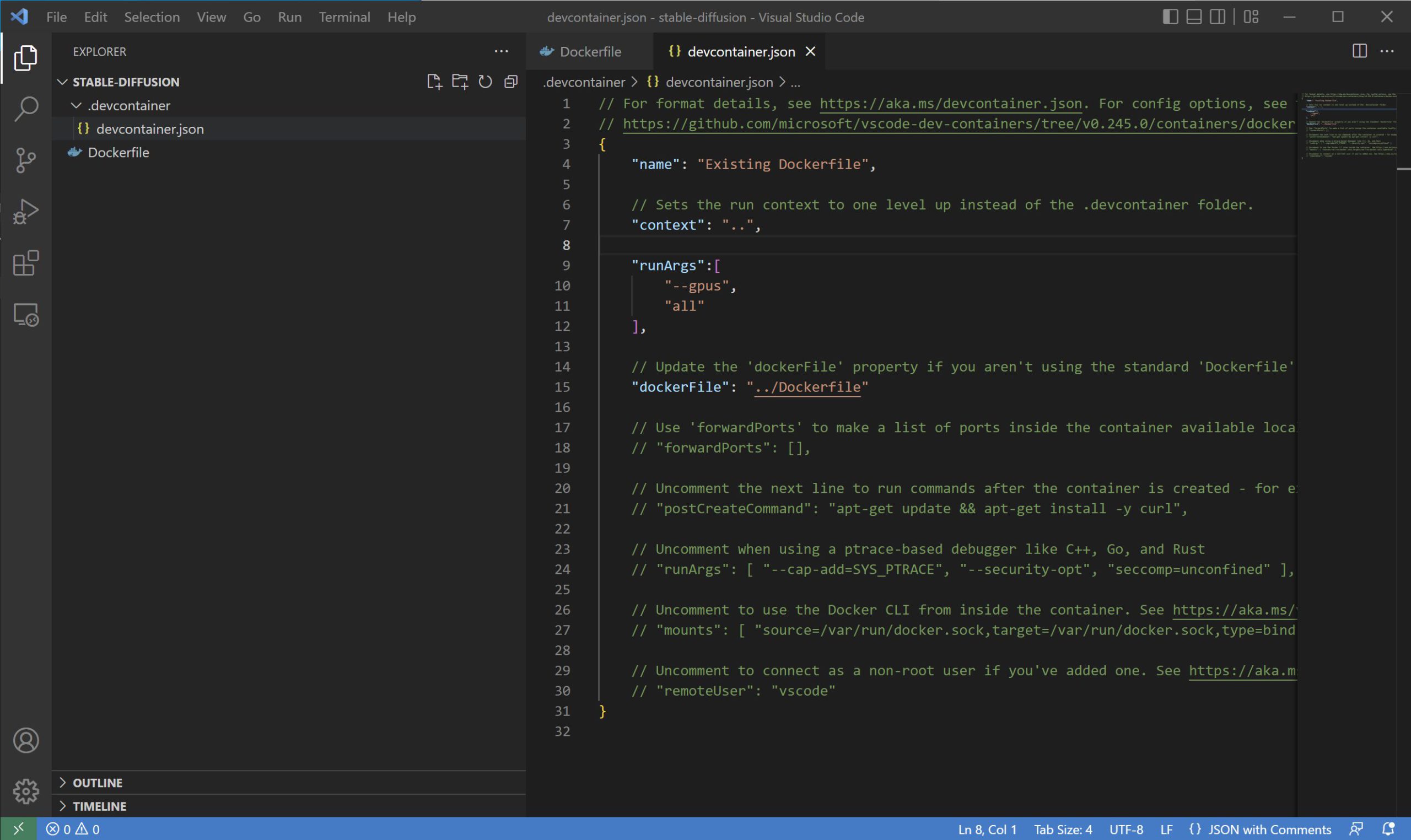

- devcontainer.jsonにrunArgsの設定を追加します。

"runArgs":[ "--gpus", "all" ],![]()

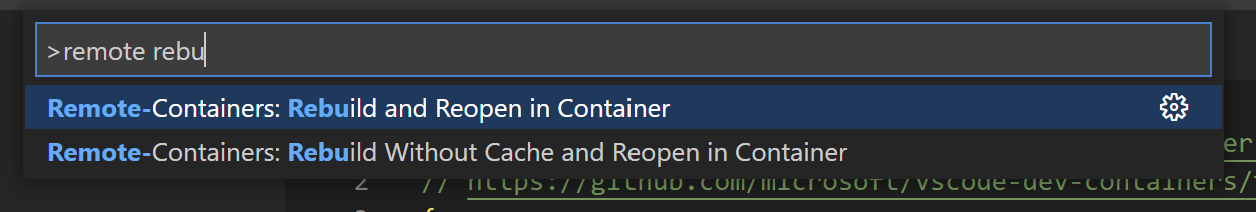

- Command Paletteを開き、検索窓に remote rebu と入力したときに表示されるRemote-Containers: Rebuild and Reopen in Containerをクリックします。

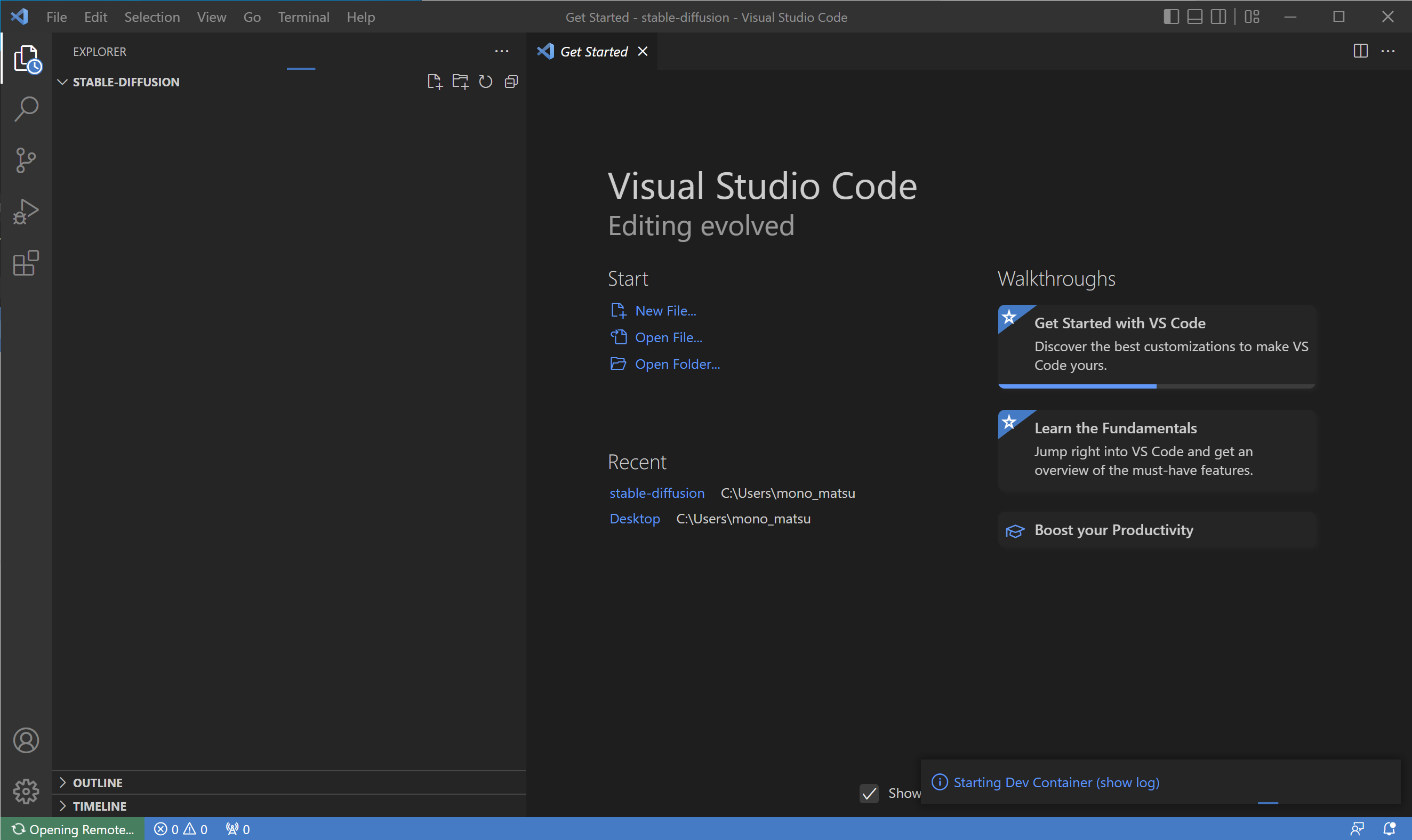

![]()

- 右下にStarting Dev Container (show log)が表示されます。消えるまでしばらく待ちます。(時間がかかります)

![]()

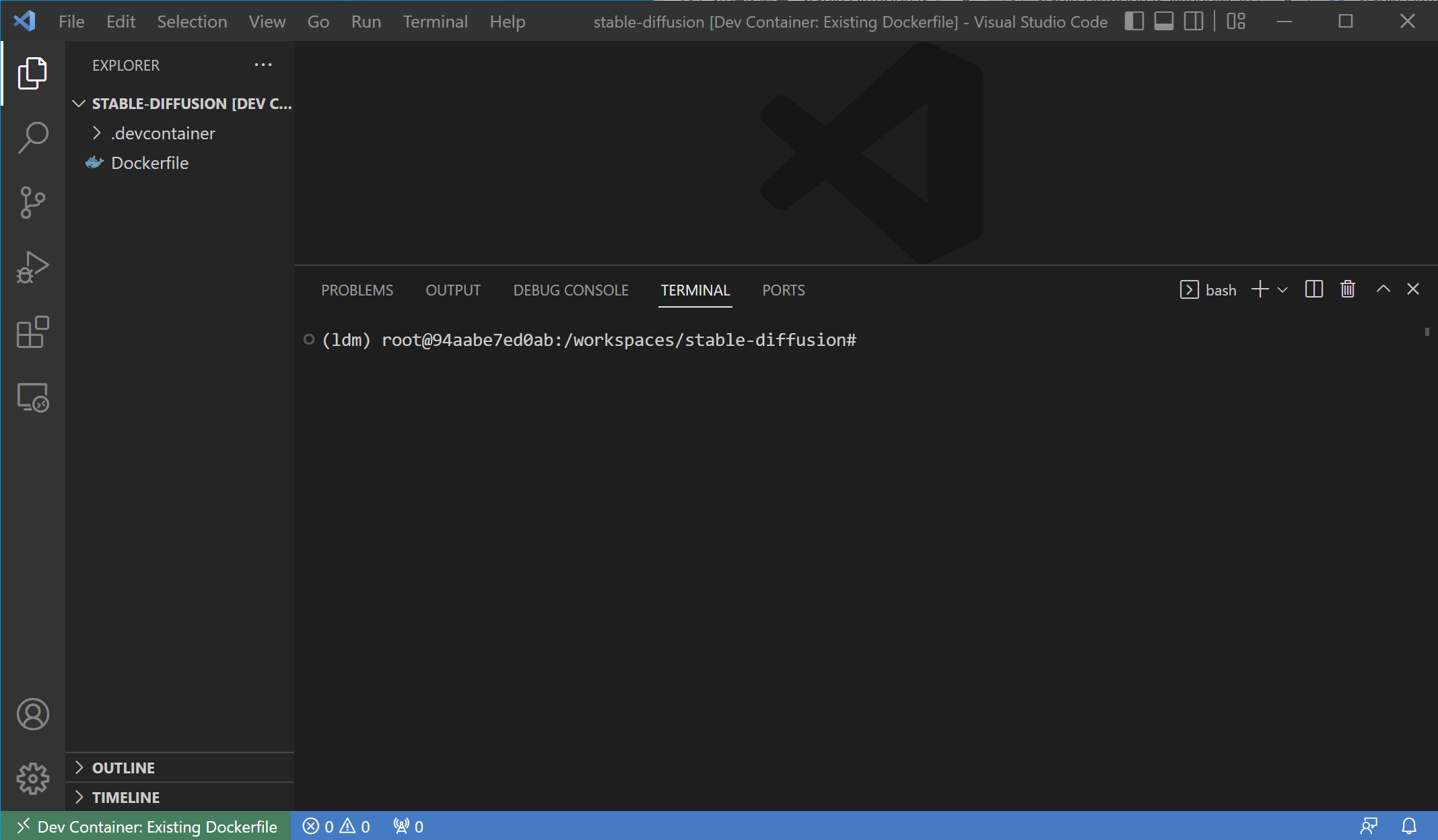

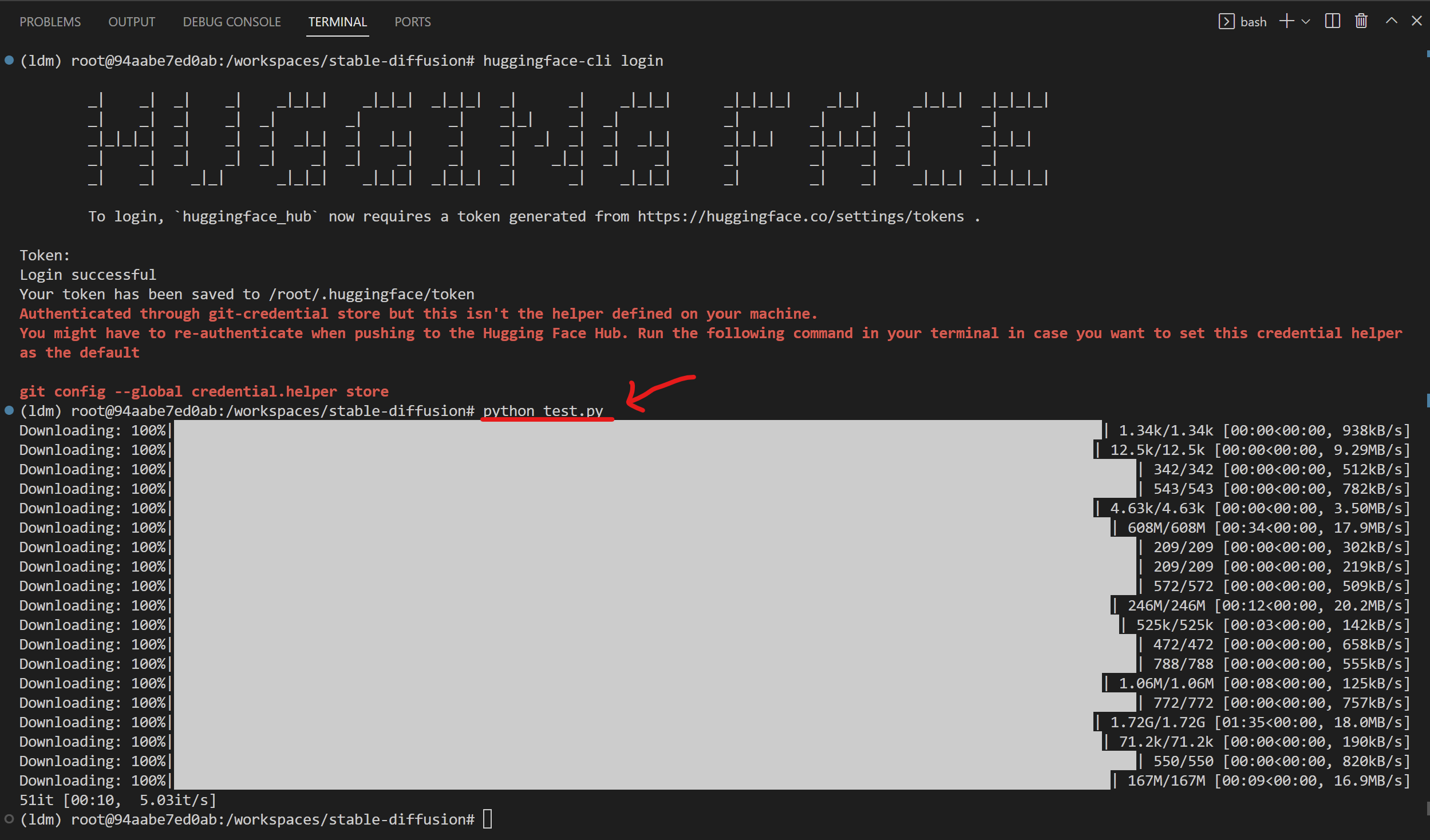

起動が完了すると、TERMINALタブに(ldm) root@94aabe7ed0ab:/workspaces/stable-diffusion#のように表示されます。

![]()

- TERMINALに以下の文字列を入力し、エンターキーを入力します。

huggingface-cli loginToken:と表示されるため、初めに入手したHugging Faceのトークンを入力してエンターキーを入力します。

Login successfulと表示されればOKです。

![]()

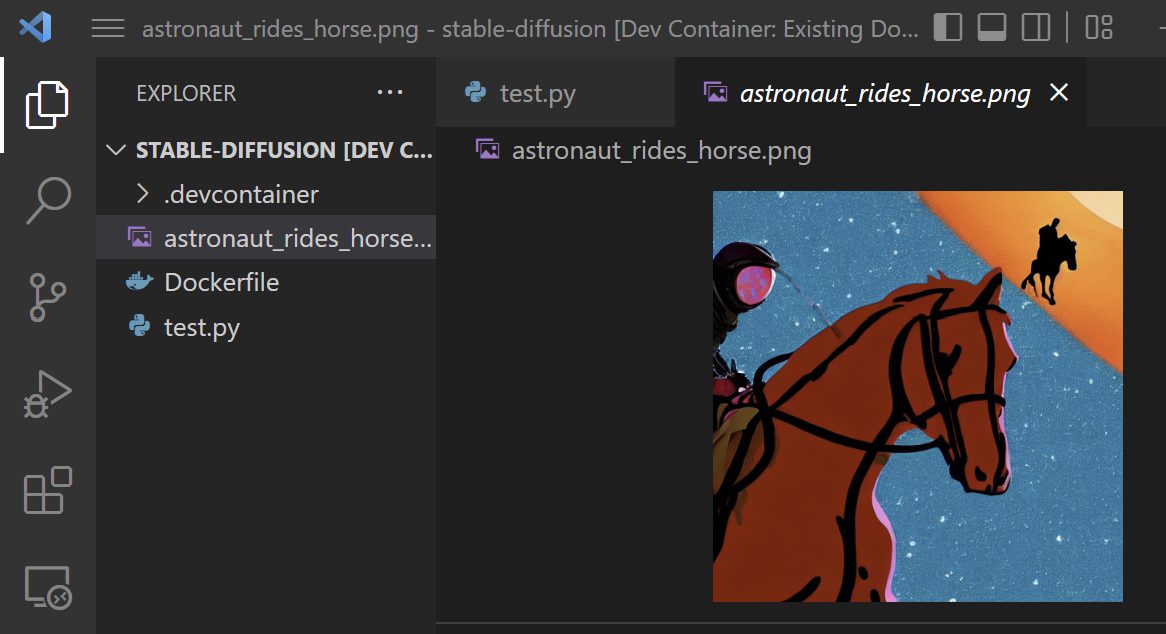

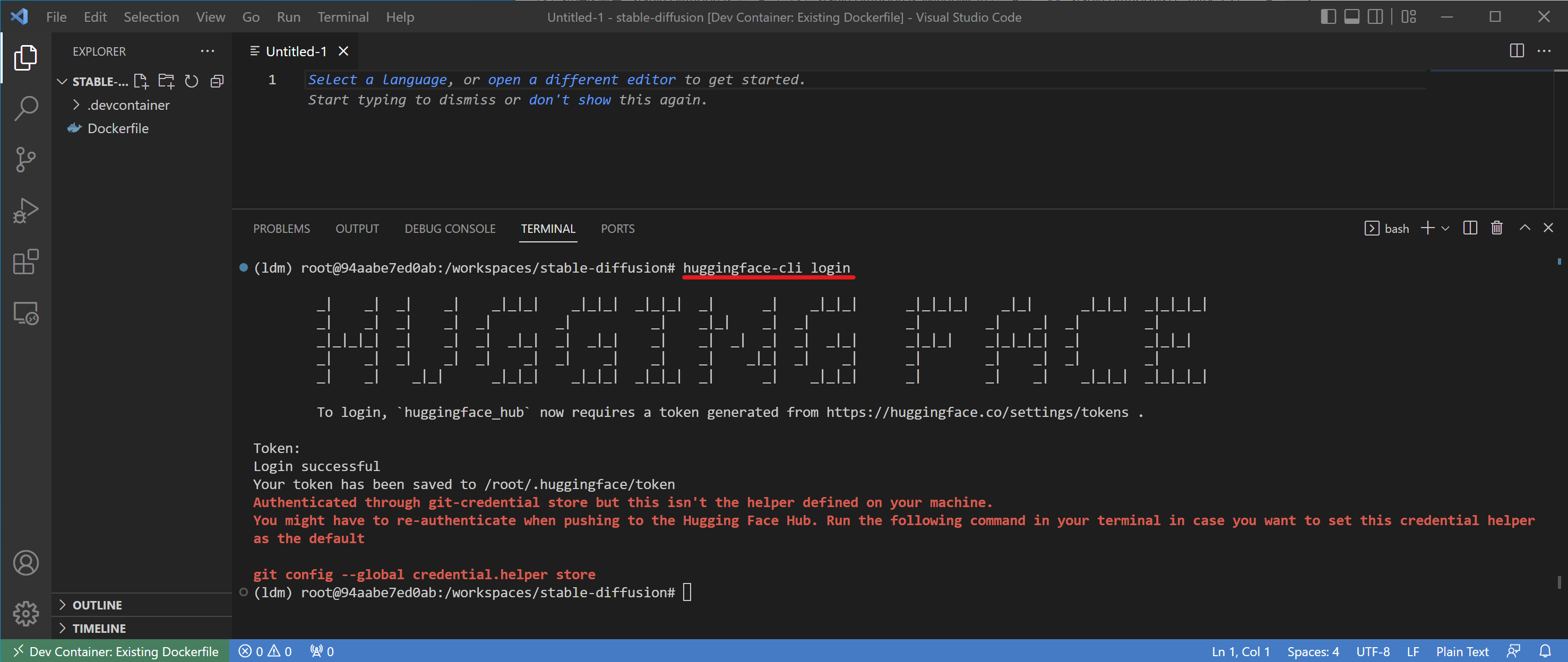

- Dockerfileを作ったときと同様の手順で、test.pyファイルを作成します。内容は以下をコピー&ペーストしてください。

13行目の prompt = "a photo of an astronaut riding a horse on mars"

この太字の箇所が生成画像を指定するワードになります。好きな言葉を入れてみて下さい。# make sure you're logged in with `huggingface-cli login` from torch import autocast import torch from diffusers import StableDiffusionPipeline pipe = StableDiffusionPipeline.from_pretrained( "CompVis/stable-diffusion-v1-4", revision="fp16", torch_dtype=torch.float16, use_auth_token=True ).to("cuda") prompt = "a photo of an astronaut riding a horse on mars" with autocast("cuda"): image = pipe(prompt)["sample"][0] image.save("astronaut_rides_horse.png")※補足: GPUのメモリが10GB以上ある方は test.py の revision, torch_dtype の指定なしで動作します。![]()

- TERMINALでtest.pyを実行します。以下のコマンドを入力してください。

python test.py![]()

コマンドが成功すると astronaut_rides_horse.png が作成されます。

![]()

![I learned from Udemy's "【UE5の総合学習】ファンタジー風景制作講座 [UE5 Comprehensive Learning] Fantasy Scenery Creation Course".

■Note

https://mononoco.com/creative/ue/ue5-rngw-22

#udemy #ue5 #unrealengine #unreal](https://mononoco.com/wp-content/plugins/instagram-feed/img/placeholder.png)